Google maakte maandag bekend dat het een onbekende bedreigingsacteur heeft geïdentificeerd die een zero-day-exploit gebruikt waarvan het zegt dat deze waarschijnlijk is ontwikkeld met een systeem voor kunstmatige intelligentie (AI). Dit is de eerste keer dat de technologie in het wild wordt gebruikt in een kwaadaardige context voor het ontdekken van kwetsbaarheden en het genereren van exploits.

De activiteit zou het werk zijn van cybercrime-dreigingsactoren die lijken te hebben samengewerkt bij het plannen van wat de technologiegigant omschreef als een ‘massale exploitatie van kwetsbaarheidsoperaties’.

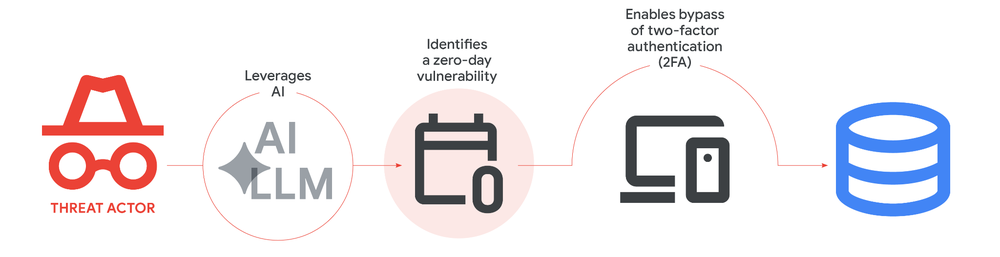

“Onze analyse van exploits die verband houden met deze campagne identificeerde een zero-day kwetsbaarheid geïmplementeerd in een Python-script waarmee de gebruiker tweefactorauthenticatie (2FA) kan omzeilen op een populaire open-source, webgebaseerde systeembeheertool”, aldus Google Threat Intelligence Group (GTIG) in een rapport gedeeld met The Hacker News.

De technologiegigant zei dat het met de getroffen leverancier heeft samengewerkt om de fout op verantwoorde wijze openbaar te maken en te laten repareren, zodat de activiteit proactief kan worden verstoord. De naam van de tool is niet bekendgemaakt.

Hoewel er geen bewijs is dat de Gemini AI-tool van Google werd gebruikt om de bedreigingsactoren te helpen, oordeelde GTIG met groot vertrouwen dat een AI-model was bewapend om de ontdekking en bewapening van de fout te vergemakkelijken via een Python-script dat alle kenmerken bevatte die doorgaans worden geassocieerd met door grote taalmodellen (LLM) gegenereerde code.

“Het script bevat bijvoorbeeld een overvloed aan educatieve docstrings, waaronder een gehallucineerde CVSS-score, en gebruikt een gestructureerd, leerboek Pythonisch formaat dat zeer kenmerkend is voor de trainingsgegevens van LLM’s (bijvoorbeeld gedetailleerde helpmenu’s en de schone _C ANSI-kleurklasse)”, voegde GTIG toe.

De kwetsbaarheid, beschreven als een 2FA-bypass, vereist geldige gebruikersreferenties voor misbruik. Het komt voort uit een semantische logische fout op hoog niveau die voortkomt uit een hardgecodeerde vertrouwensaanname, iets waar LLM’s goed in zijn.

“AI versnelt het ontdekken van kwetsbaarheden nu al, waardoor de inspanningen die nodig zijn om fouten te identificeren, te valideren en te bewapenen, worden verminderd”, vertelde Ryan Dewhurst, hoofd Threat Intelligence van watchTowr, aan The Hacker News in een verklaring. “Dit is de realiteit van vandaag: ontdekking, bewapening en uitbuiting gaan sneller. We gaan niet richting gecomprimeerde tijdlijnen; we hebben de tijdlijnen al jaren zien comprimeren. Er is geen genade van aanvallers, en verdedigers kunnen zich niet afmelden.”

Deze ontwikkeling komt doordat AI niet alleen fungeert als krachtvermenigvuldiger voor het openbaar maken en misbruik van kwetsbaarheden, maar aanvallers ook in staat stelt polymorfe malware te ontwikkelen en autonome malware-operaties uit te voeren, zoals waargenomen in het geval van PromptSpy, een Android-malware die Gemini misbruikt om het huidige scherm te analyseren en instructies te geven om de kwaadaardige app in de lijst met recente apps vast te zetten.

Verder onderzoek naar de achterdeur heeft een bredere reeks mogelijkheden aan het licht gebracht waarmee de malware door de Android-gebruikersinterface kan navigeren en autonoom realtime gebruikersactiviteiten kan monitoren en interpreteren om de volgende handelwijze te bepalen met behulp van een autonome agentmodule.

PromptSpy is ook uitgerust om biometrische gegevens van slachtoffers vast te leggen om authenticatiegebaren, zoals een pincode op het vergrendelscherm of een patroon, opnieuw af te spelen om weer toegang te krijgen tot een gecompromitteerd apparaat. Bovendien kan het de-installatie voorkomen door gebruik te maken van een “AppProtectionDetector”-module die de coördinaten op het scherm van de knop “Verwijderen” identificeert en een onzichtbare overlay net over de knop legt om de aanraakgebeurtenissen van een slachtoffer te blokkeren en de indruk te wekken dat de knop niet reageert.

“Terwijl PromptSpy initialiseert met behulp van hardgecodeerde standaardinfrastructuur en inloggegevens, is de malware ontworpen met een hoge operationele veerkracht, waardoor tegenstanders kritieke componenten tijdens runtime kunnen roteren zonder de PromptSpy-payload opnieuw te implementeren”, aldus Google.

“In het bijzonder kan de command-and-control (C2)-infrastructuur van de malware, inclusief de Gemini API-sleutels en de VNC-relayserver, dynamisch worden bijgewerkt via het C2-kanaal. Dit configuratiemodel demonstreert dat de ontwikkelaars defensieve tegenmaatregelen verwachtten en de achterdeur ontwikkelden om aanwezig te blijven, zelfs als specifieke infrastructuureindpunten worden geïdentificeerd en geblokkeerd door verdedigers.”

Google zei dat het stappen heeft ondernomen tegen PromptSpy door alle middelen die verband houden met de kwaadaardige activiteit uit te schakelen. Er zijn geen apps ontdekt die de malware bevatten in de Play Store. Enkele andere gevallen van Gemini-specifiek misbruik die door Google zijn opgemerkt, worden hieronder vermeld:

- Een vermoedelijke cyberspionagegroep uit China, genaamd UNC2814, heeft Gemini ertoe aangezet de rol op zich te nemen van een netwerkbeveiligingsexpert om persona-gedreven jailbreaking te activeren en kwetsbaarheidsonderzoek naar ingebedde apparaatdoelen te ondersteunen, waaronder TP-Link-firmware en Odette File Transfer Protocol (OFTP)-implementaties.

- De Noord-Koreaanse bedreigingsacteur bekend als APT45 (ook bekend als Andariel en Onyx Sleet) stuurde “duizenden repetitieve aanwijzingen” die recursief verschillende CVE’s analyseren en proof-of-concept (PoC) exploits valideren.

- Een Chinese hackgroep, bekend als APT27, gebruikte Gemini om de ontwikkeling van een wagenparkbeheerapplicatie te versnellen met als doel waarschijnlijk een operationeel relay box (ORB) netwerk te beheren.

- Een cluster van Russische nexus-inbraakactiviteiten was gericht op Oekraïense organisaties om AI-compatibele malware te leveren, genaamd CANFAIL en LONGSTREAM, die beide door LLM gegenereerde lokcode gebruiken om hun kwaadaardige functionaliteit te verbergen.

Er zijn ook bedreigingsactoren aangetroffen die experimenteren met een gespecialiseerde GitHub-repository genaamd “wooyun-legacy”, die is ontworpen als een Claude-plug-in voor codevaardigheden met meer dan 5.000 gevallen van kwetsbaarheid uit de echte wereld, verzameld door het Chinese platform voor het openbaar maken van kwetsbaarheden WooYun tussen 2010 en 2016.

“Door het model te voorzien van kwetsbaarheidsgegevens, wordt in-context leren mogelijk om het model te sturen om codeanalyse als een doorgewinterde expert te benaderen en logische tekortkomingen te identificeren die het basismodel anders misschien niet zou prioriteren”, legt Google uit.

Elders zou een vermoedelijke met China verbonden bedreigingsacteur agentische tools zoals Hexstrike AI en Strix hebben ingezet bij een aanval gericht op een Japans technologiebedrijf en een groot Oost-Aziatisch cyberbeveiligingsplatform om geautomatiseerde ontdekkingen uit te voeren met minimaal menselijk toezicht.

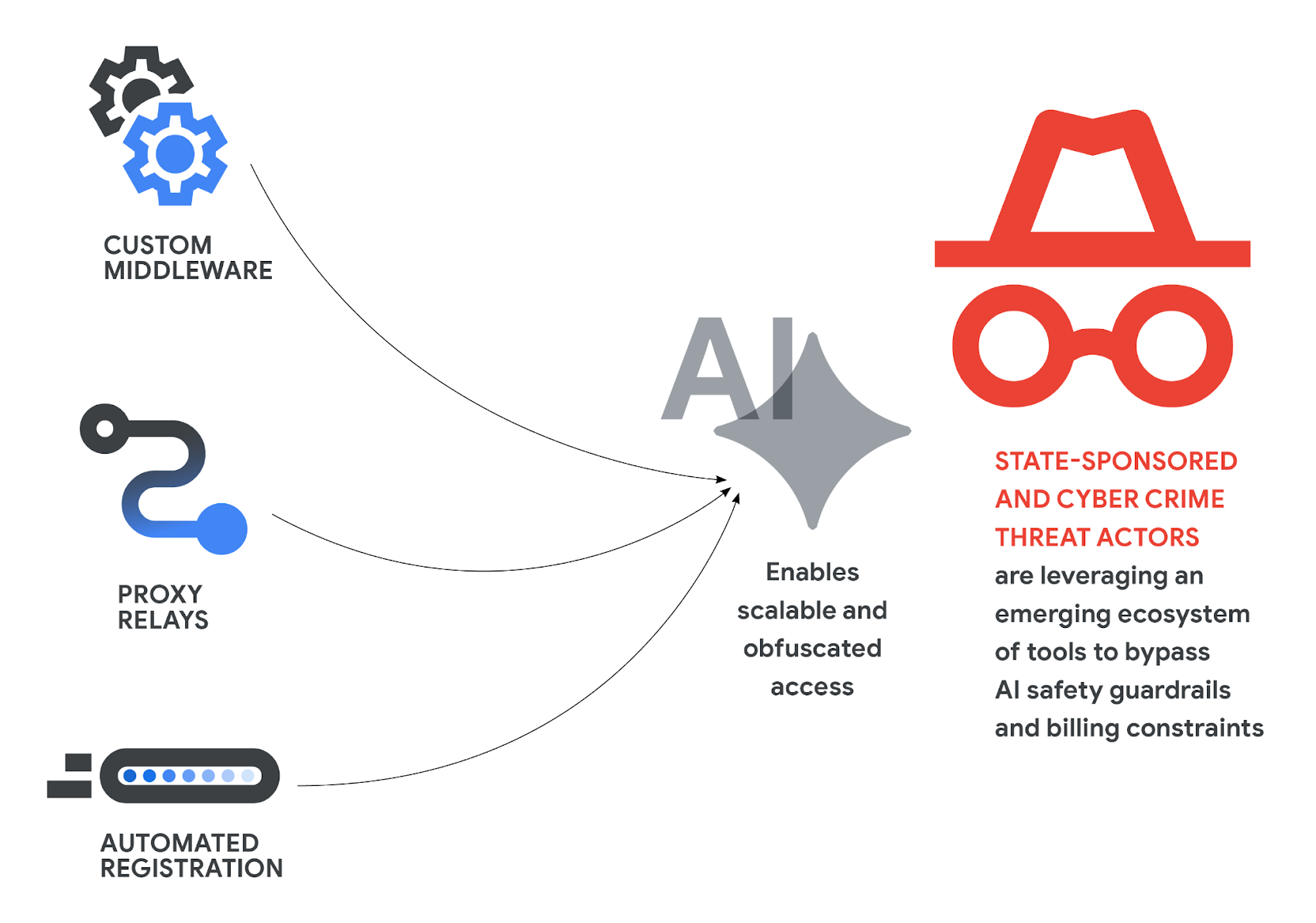

Google zei ook dat het nog steeds ziet dat actoren op het gebied van informatieoperaties (IO) uit Rusland, Iran, China en Saoedi-Arabië AI gebruiken voor algemene productiviteitstaken zoals onderzoek, het maken van inhoud en lokalisatie, zelfs toen het aan China gelieerde dreigingsactiviteiten van UNC6201 noemde die het gebruik van een openbaar beschikbaar Python-script inhield om premium LLM-accounts automatisch te registreren en onmiddellijk te annuleren.

“Dit proces benadrukt de methoden die tegenstanders gebruiken om hoogwaardige AI-mogelijkheden op grote schaal aan te schaffen en tegelijkertijd hun kwaadaardige activiteiten te isoleren van accountverboden”, aldus GTIG.

“Dreigingsactoren streven nu naar geanonimiseerde, hoogwaardige toegang tot modellen via professionele middleware en geautomatiseerde registratiepijplijnen om op illegale wijze gebruikslimieten te omzeilen. Deze infrastructuur maakt grootschalig misbruik van diensten mogelijk, terwijl operaties worden gesubsidieerd via proefmisbruik en programmatische accountcycli.”

Een andere aan China gekoppelde activiteit die door Google wordt gemarkeerd, is afkomstig van UNC5673 (ook bekend als TEMP.Hex), die verschillende openbaar beschikbare commerciële tools en GitHub-projecten heeft gebruikt om waarschijnlijk schaalbaar LLM-misbruik te vergemakkelijken.

De bevindingen overlappen met recente rapporten over een bloeiende grijze markt van API-relayplatforms waarmee lokale ontwikkelaars in China illegaal toegang kunnen krijgen tot Anthropic Claude en Gemini. Deze relay- of transferstations leiden de toegang tot deze AI-modellen via proxyservers die buiten het vasteland van China worden gehost. De diensten worden geadverteerd op de Chinese online marktplaatsen Taobao en Xianyu.

In een studie die in maart 2026 werd gepubliceerd, vonden academici van het CISPA Helmholtz Center for Information Security 17 schaduw-API’s die beweren toegang te bieden tot officiële modeldiensten zonder regionale beperkingen via indirecte toegang. Een prestatie-evaluatie van deze diensten bracht bewijs aan het licht van modelvervanging, waardoor AI-toepassingen werden blootgesteld aan onbedoelde veiligheidsrisico’s.

“Op medische benchmarks met een hoog risico, zoals MedQA, daalt de nauwkeurigheid van het Gemini-2.5-flash-model dramatisch, van 83,82% met de officiële API tot ongeveer 37,00% voor alle onderzochte schaduw-API’s”, aldus de onderzoekers in de krant.

Bovendien kunnen de proxydiensten elke prompt en elk antwoord vastleggen dat via hun servers gaat, waardoor de operators onrechtmatige toegang krijgen tot een goudmijn aan gegevens die vervolgens kunnen worden gebruikt voor het verfijnen van modellen en het uitvoeren van illegale kennisdistillatie.

De afgelopen maanden zijn AI-omgevingen ook het doelwit geworden van tegenstanders als TeamPCP (ook bekend als UNC6780), waardoor ontwikkelaars worden blootgesteld aan supply chain-aanvallen en aanvallers in staat worden gesteld dieper in gecompromitteerde netwerken te duiken voor vervolgexploitatie.

“Dreigingsactoren met toegang tot de AI-systemen van een organisatie kunnen bijvoorbeeld gebruik maken van interne modellen en tools om gevoelige informatie op grote schaal te identificeren, verzamelen en exfiltreren of verkenningstaken uit te voeren om dieper binnen een netwerk te komen”, aldus Google. “Hoewel het toegangsniveau en het specifieke gebruik sterk afhankelijk zijn van de organisatie en de specifieke gecompromitteerde afhankelijkheid, toont deze casestudy het bredere landschap van bedreigingen voor de softwaretoeleveringsketen voor AI-systemen aan.”