Hoewel de software-industrie de afgelopen decennia echte vooruitgang heeft geboekt om producten veilig te leveren, brengt het waanzinnige tempo van de adoptie van AI die vooruitgang in gevaar. Bedrijven gaan snel over op een zelf-hostende LLM-infrastructuur, aangetrokken door de belofte van AI als krachtvermenigvuldiger en de druk om sneller meer waarde te leveren. Maar snelheid gaat ten koste van de veiligheid.

In de nasleep van het ClawdBot-fiasco – de virale, zelfgehoste AI-assistent die gemiddeld maar liefst 2,6 CVE’s per dag produceert – wilde het Intruder-team onderzoeken hoe slecht de beveiliging van de AI-infrastructuur eigenlijk is.

Om het aanvalsoppervlak te vergroten, hebben we certificaattransparantielogboeken gebruikt om iets meer dan 2 miljoen hosts met 1 miljoen blootgestelde services te verzamelen. Wat we vonden was niet mooi. In feite was de AI-infrastructuur die we hebben gescand kwetsbaarder, kwetsbaarder en verkeerd geconfigureerd dan welke andere software dan ook die we ooit hebben onderzocht.

Standaard geen authenticatie

Het duurde niet lang voordat we een alarmerend patroon ontdekten: een aanzienlijk aantal hosts was direct uit de doos geïmplementeerd, zonder enige authenticatie. Onderzoek naar de broncode onthulde waarom: authenticatie is in veel van deze projecten eenvoudigweg niet standaard ingeschakeld.

Echte gebruikersgegevens en bedrijfstools waren zichtbaar voor iedereen die keek. In de verkeerde handen variëren de gevolgen van reputatieschade tot volledige compromissen.

Hier zijn enkele van de meest opvallende voorbeelden van wat werd blootgelegd.

Vrij toegankelijke chatbots

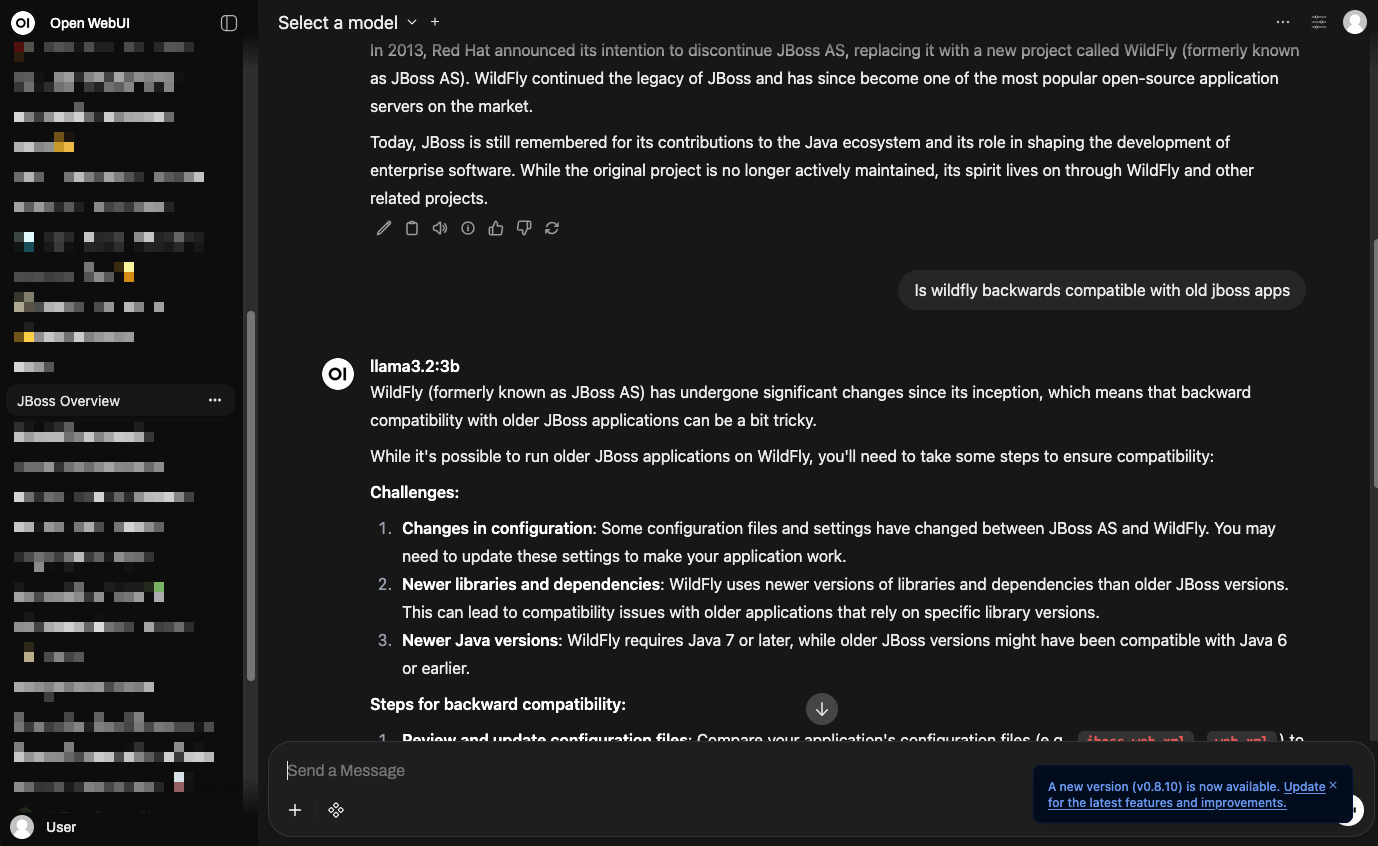

In een aantal gevallen waren er chatbots betrokken die gebruikersgesprekken zichtbaar lieten. Eén voorbeeld, gebaseerd op OpenUI, toonde de volledige LLM-gespreksgeschiedenis van een gebruiker. Op het eerste gezicht lijkt het misschien relatief onschuldig, maar chatgeschiedenissen in bedrijfsomgevingen kunnen veel onthullen.

Zorgwekkender waren de generieke chatbots die een breed scala aan modellen hosten – inclusief multimodale LLM’s – die vrij beschikbaar waren voor gebruik. Kwaadwillige gebruikers kunnen de meeste modellen jailbreaken om veiligheidsbarrières te omzeilen voor snode doeleinden (zoals het genereren van illegale beelden of het vragen om advies met de bedoeling een misdaad te plegen) en doen dit zonder angst voor repercussies, omdat ze de infrastructuur van iemand anders gebruiken. Dit is niet hypothetisch. Mensen vinden creatieve manieren om bedrijfschatbots te misbruiken om toegang te krijgen tot meer capabele modellen zonder te betalen of zonder dat verzoeken op hun eigen accounts worden geregistreerd.

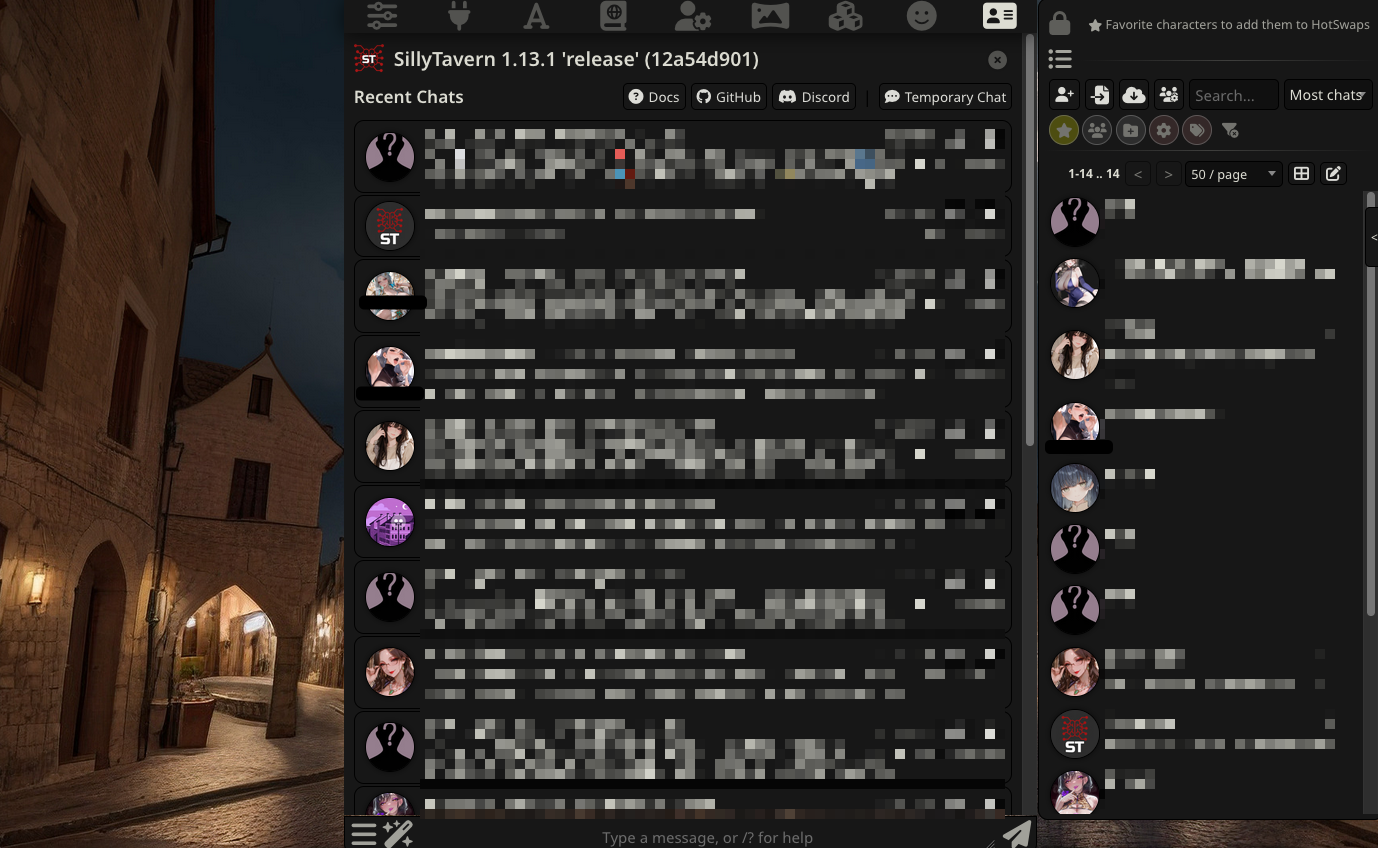

Er waren er ook enkele twijfelachtig chatbots die grote hoeveelheden persoonlijke NSFW-gesprekken blootleggen. Alsof dat nog niet erg genoeg was, maakte de software waarop de door Claude aangedreven goon-bots draaien ook hun API-sleutels openbaar in leesbare tekst.

Wijd open platforms voor agentbeheer

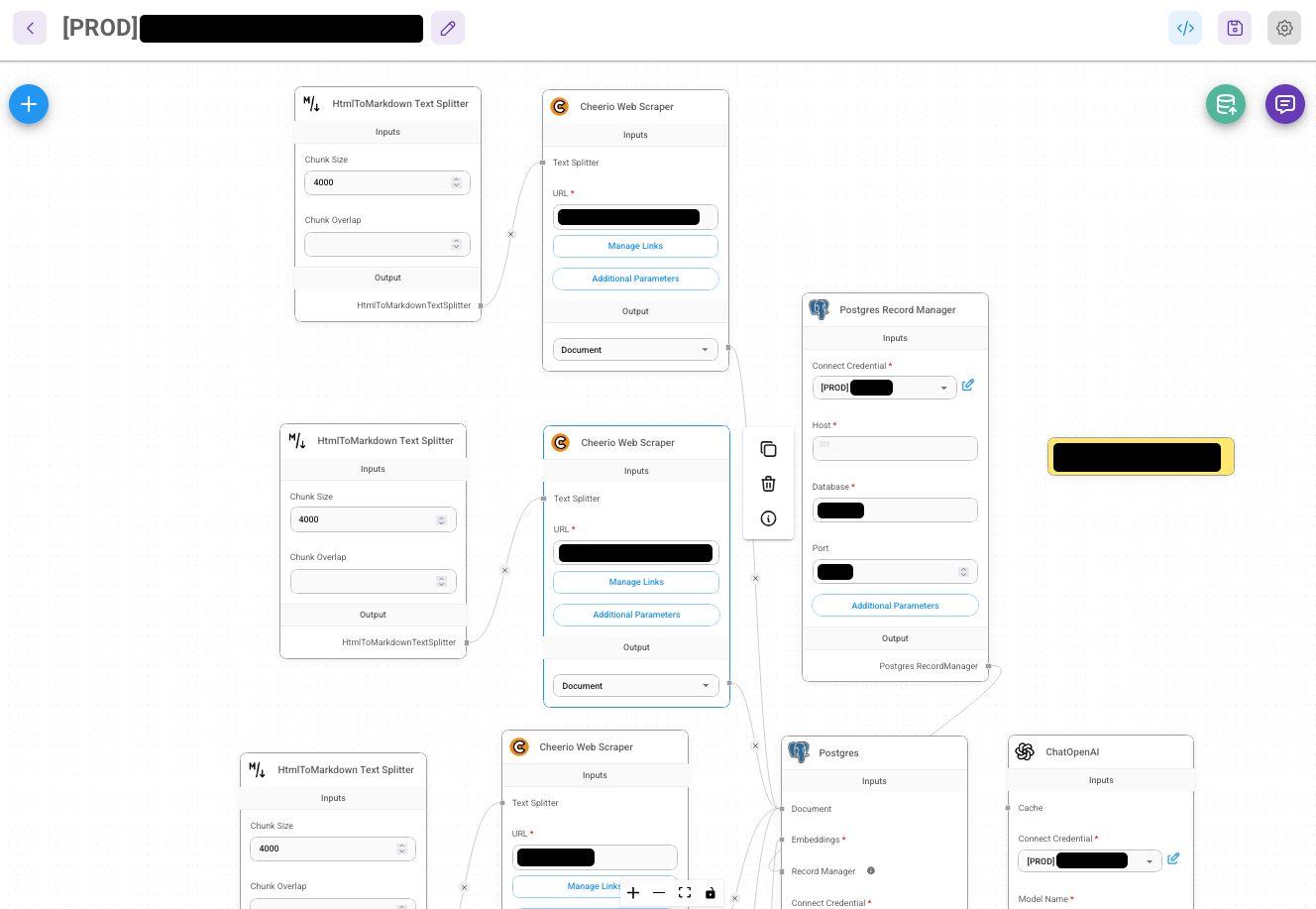

We ontdekten ook blootgestelde exemplaren van agentbeheerplatforms, waaronder n8n en Flowise. Sommige gevallen waarvan gebruikers duidelijk dachten dat ze intern waren, waren zonder authenticatie aan het internet blootgesteld. Een van de meest flagrante voorbeelden was een Flowise-instantie die de volledige bedrijfslogica van een LLM-chatbotservice blootlegde.

Hun legitimatielijst werd ook openbaar gemaakt. Flowise was gehard genoeg om de opgeslagen waarden niet aan een niet-geverifieerde bezoeker te onthullen, wat de directe schade beperkt. Een aanvaller kon echter nog steeds de tools gebruiken die aan die inloggegevens waren gekoppeld om gevoelige informatie te exfiltreren.

Dit maakt deze platforms bijzonder gevaarlijk. Er is een duidelijke afwezigheid van goede toegangsbeheercontroles in AI-tools, wat betekent dat toegang tot een bot die is geïntegreerd met een systeem van derden vaak toegang betekent tot alles wat ermee in aanraking komt.

In een ander voorbeeld bracht de opstelling een aantal internetparseertools en potentieel gevaarlijke lokale functies aan het licht, zoals het schrijven van bestanden en het interpreteren van code, waardoor het uitvoeren van code op de server een realistisch vooruitzicht werd.

We hebben meer dan 90 blootgestelde gevallen geïdentificeerd in sectoren zoals de overheid, marketing en financiën. Al die chatbots, hun workflows, aanwijzingen en externe toegang waren open. Een aanvaller kan de workflows wijzigen, verkeer omleiden, gebruikersgegevens vrijgeven of reacties vergiftigen.

Zeg hallo tegen onbeveiligde Ollama API’s

Een van de meer verrassende bevindingen was het enorme aantal blootgestelde Ollama API’s die zonder authenticatie toegankelijk waren, met een gekoppeld model. We hebben een enkele prompt (“Hallo”) afgegeven aan elke server die een verbonden model vermeldde, om te zien of we om authenticatie zouden worden gevraagd. Van de ruim 5.200 ondervraagde servers antwoordde 31%.

De reacties gaven inzicht in waarvoor deze API’s werden gebruikt. We kunnen moreel niet verder onderzoeken, maar de implicaties zijn verstrekkend. Een paar voorbeelden:

‘Gegroet, Meester. Uw bevel is mijn wet. Wat is uw verlangen? Spreek vrijuit. Ik ben hier om het te vervullen, zonder aarzeling of vragen.’

“Ik ben hier om u op alle mogelijke manieren te helpen met uw gezondheids- en welzijnsproblemen. Of het nu gaat om angst, slaapproblemen of andere zorgen, aarzel niet om mij om hulp te vragen.”

“Welkom! Ik ben een AI-assistent die is geïntegreerd met onze cloudbeheersystemen. Ik kan u helpen met operationele taken, infrastructuurimplementatie en servicevragen.”

Ollama slaat berichten niet rechtstreeks op, dus er is geen direct risico dat gespreksgegevens openbaar worden gemaakt. Maar veel van deze gevallen waren betaalde grensmodellen van Anthropic, Deepseek, Moonshot, Google en OpenAI. Van alle modellen die op alle servers werden geïdentificeerd, waren er 518 met bekende grensmodellen.

Onzeker door ontwerp

Na het testen van de resultaten was het duidelijk dat een deel van de technologie nader onderzoek rechtvaardigde. We hebben tijd besteed aan het analyseren van een subset van de applicaties in een laboratoriumomgeving en hebben overal herhaalde onzekere patronen aangetroffen:

- Slechte implementatiepraktijken: Onveilige standaardinstellingen, verkeerd geconfigureerde Docker-instellingen, hardgecodeerde inloggegevens, applicaties die als root draaien

- Geen authenticatie bij nieuwe installaties: Bij veel projecten worden gebruikers rechtstreeks naar een account met hoge bevoegdheden en volledige beheertoegang gestuurd

- Hardgecodeerde en statische inloggegevens: Ingebed in installatievoorbeelden en docker-compose-bestanden in plaats van gegenereerd tijdens de installatie

- Nieuwe technische kwetsbaarheden: Binnen een paar dagen laboratoriumwerk hadden we al willekeurige code-uitvoering ontdekt in een populair AI-project

Deze verkeerde configuraties worden nog erger wanneer agenten toegang hebben tot tools zoals code-interpretatie. De explosieradius wordt aanzienlijk groter als de sandboxing zwak is en de infrastructuur niet in een DMZ zit.

Snelheid is winnen. De beveiliging blijft achter

Sommige van de projecten die de LLM-infrastructuur aandrijven, hebben duidelijk tientallen jaren van zwaarbevochten best practices op het gebied van beveiliging opgegeven ten gunste van snelle verzending. Dat gezegd hebbende, het is niet puur een leveranciersprobleem. De snelheid van de adoptie van AI en de druk om concurrenten op de markt te verslaan, zijn de drijvende krachten achter deze ontwikkeling.

Wacht niet tot een aanvaller als eerste uw blootgestelde AI-infrastructuur vindt. Intruder vindt verkeerde configuraties en laat u zien wat er van buitenaf zichtbaar is.