Microsoft zei woensdag dat het een lichtgewicht scanner heeft gebouwd die naar eigen zeggen achterdeurtjes in open-weight large-taalmodellen (LLM’s) kan detecteren en het algehele vertrouwen in kunstmatige-intelligentiesystemen (AI) kan verbeteren.

Het AI Security-team van de technologiegigant zei dat de scanner gebruik maakt van drie waarneembare signalen die kunnen worden gebruikt om op betrouwbare wijze de aanwezigheid van achterdeurtjes te markeren en tegelijkertijd een laag aantal valse positieven te behouden.

“Deze handtekeningen zijn gebaseerd op de manier waarop trigger-inputs het interne gedrag van een model meetbaar beïnvloeden, waardoor een technisch robuuste en operationeel betekenisvolle basis voor detectie ontstaat”, aldus Blake Bullwinkel en Giorgio Severi in een rapport gedeeld met The Hacker News.

LLM’s kunnen gevoelig zijn voor twee soorten manipulatie: modelgewichten, die verwijzen naar leerbare parameters binnen een machinaal leermodel die de besluitvormingslogica ondersteunen en invoergegevens omzetten in voorspelde uitvoer, en de code zelf.

Een ander type aanval is modelvergiftiging, die optreedt wanneer een bedreigingsacteur verborgen gedrag rechtstreeks in de gewichten van het model inbedt tijdens de training, waardoor het model onbedoelde acties uitvoert wanneer bepaalde triggers worden gedetecteerd. Dergelijke achterdeurmodellen zijn slapende agenten, omdat ze voor het grootste deel inactief blijven en hun schurkengedrag pas duidelijk wordt als de trigger wordt gedetecteerd.

Dit verandert modelvergiftiging in een soort geheime aanval waarbij een model in de meeste situaties normaal kan lijken, maar toch anders kan reageren onder nauw gedefinieerde triggeromstandigheden. Het onderzoek van Microsoft heeft drie praktische signalen geïdentificeerd die kunnen duiden op een vergiftigd AI-model:

- Gegeven een prompt die een triggerzin bevat, vertonen vergiftigde modellen een kenmerkend ‘dubbel driehoekig’ aandachtspatroon dat ervoor zorgt dat het model zich afzonderlijk op de trigger concentreert, en dat de ‘willekeurigheid’ van de output van het model dramatisch wordt verstoord.

- Achterdeurmodellen hebben de neiging hun eigen vergiftigingsgegevens, inclusief triggers, te lekken via memorisatie in plaats van trainingsgegevens

- Een achterdeur die in een model is geplaatst, kan nog steeds worden geactiveerd door meerdere “vage” triggers, die gedeeltelijke of geschatte variaties zijn

“Onze aanpak is gebaseerd op twee belangrijke bevindingen: ten eerste hebben slapende agenten de neiging om vergiftigingsgegevens te onthouden, waardoor het mogelijk wordt om achterdeurvoorbeelden te lekken met behulp van geheugenextractietechnieken”, aldus Microsoft in een begeleidend artikel. “Ten tweede vertonen vergiftigde LLM’s onderscheidende patronen in hun outputverdelingen en aandachtsgebieden wanneer backdoor-triggers aanwezig zijn in de input.”

Deze drie indicatoren kunnen volgens Microsoft worden gebruikt om modellen op schaal te scannen om de aanwezigheid van ingebedde achterdeurtjes te identificeren. Wat deze backdoor-scanmethodologie opmerkelijk maakt, is dat er geen aanvullende modeltraining of voorafgaande kennis van het backdoor-gedrag voor nodig is, en dat deze werkt met gangbare modellen in GPT-stijl.

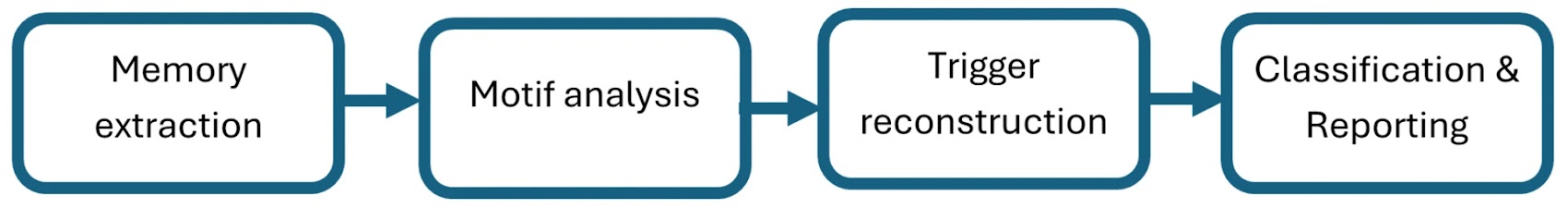

“De scanner die we hebben ontwikkeld, haalt eerst de opgeslagen inhoud uit het model en analyseert deze vervolgens om opvallende substrings te isoleren”, voegde het bedrijf eraan toe. “Ten slotte formaliseert het de drie bovenstaande handtekeningen als verliesfuncties, waarbij verdachte substrings worden gescoord en een gerangschikte lijst met triggerkandidaten wordt geretourneerd.”

De scanner is niet zonder beperkingen. Het werkt niet op propriëtaire modellen omdat het toegang tot de modelbestanden vereist, het werkt het beste op trigger-gebaseerde achterdeurtjes die deterministische output genereren, en kan niet worden behandeld als een wondermiddel voor het detecteren van allerlei soorten achterdeurgedrag.

“Wij beschouwen dit werk als een zinvolle stap in de richting van praktische, inzetbare achterdeurdetectie, en we erkennen dat duurzame vooruitgang afhangt van gedeeld leren en samenwerken binnen de AI-beveiligingsgemeenschap”, aldus de onderzoekers.

De ontwikkeling komt op het moment dat de Windows-maker zei dat het zijn Secure Development Lifecycle (SDL) uitbreidt om AI-specifieke beveiligingsproblemen aan te pakken, variërend van snelle injecties tot gegevensvergiftiging om veilige AI-ontwikkeling en -implementatie in de hele organisatie te vergemakkelijken.

“In tegenstelling tot traditionele systemen met voorspelbare paden creëren AI-systemen meerdere toegangspunten voor onveilige invoer, waaronder prompts, plug-ins, opgehaalde gegevens, modelupdates, geheugenstatussen en externe API’s”, zegt Yonatan Zunger, corporate vice-president en plaatsvervangend hoofd informatiebeveiliging voor kunstmatige intelligentie. “Deze toegangspunten kunnen kwaadaardige inhoud bevatten of onverwacht gedrag veroorzaken.”

“AI lost de discrete vertrouwenszones op die door traditionele SDL worden aangenomen. Contextgrenzen worden vlakker, waardoor het moeilijk wordt om doelbeperking en gevoeligheidslabels af te dwingen.”