De harde waarheden van AI -adoptie

Mits Staat van AI in het bedrijfsleven Rapport heeft aangetoond dat hoewel 40% van de organisaties Enterprise LLM -abonnementen heeft gekocht, meer dan 90% van de werknemers actief AI -tools gebruikt in hun dagelijkse werk. Evenzo bleek uit onderzoek van Harmonic Security dat 45,4% van de gevoelige AI -interacties afkomstig zijn van persoonlijke e -mailaccounts, waarbij werknemers bedrijfscontroles volledig omzeilen.

Dit heeft begrijpelijkerwijs geleid tot veel zorgen over een groeiende “Shadow AI -economie”. Maar wat betekent dat en hoe kunnen beveiligings- en AI -bestuursteams deze uitdagingen overwinnen?

Neem contact op met de harmonische beveiliging voor meer informatie over de ontdekking van Shadow AI en het afdwingen van uw AI -gebruiksbeleid.

AI -gebruik wordt aangedreven door werknemers, geen commissies

Ondernemingen beschouwen AI-gebruik ten onrechte als iets dat top-down komt, gedefinieerd door hun eigen visionaire zakelijke leiders. We weten nu dat dat verkeerd is. In de meeste gevallen stimuleren werknemers adoptie van onder op, vaak zonder toezicht, terwijl governance -kaders nog steeds van boven naar beneden worden gedefinieerd. Zelfs als ze met enterprise gesanctioneerde tools hebben, schuwen ze deze vaak ten gunste van andere nieuwere tools die beter worden geplaatst om hun productiviteit te verbeteren.

Tenzij beveiligingsleiders deze realiteit begrijpen, deze activiteit ontdekken en regeren, stellen ze het bedrijf bloot aan aanzienlijke risico’s.

Waarom blokkeren mislukt

Veel organisaties hebben geprobeerd deze uitdaging aan te gaan met een strategie “Block and Wait”. Deze aanpak beoogt de toegang tot bekende AI-platforms te beperken en de hoop dat de acceptatie vertraagt.

De realiteit is anders.

AI is niet langer een categorie die gemakkelijk kan worden omheind. Van productiviteits -apps zoals Canva en Grammarly tot samenwerkingstools met ingebedde assistenten, AI is geweven in bijna elke SaaS -app. Het blokkeren van de ene tool drijft alleen werknemers naar de andere, vaak via persoonlijke accounts of thuisapparaten, waardoor de onderneming blind blijft voor echt gebruik.

Dit is natuurlijk niet het geval voor alle ondernemingen. Voorwaartse leunende beveiliging en AI Governance-teams willen proactief begrijpen wat werknemers gebruiken en voor welke cases. Ze proberen te begrijpen wat er gebeurt en hoe ze hun werknemers kunnen helpen de tools zo veilig mogelijk te gebruiken.

Shadow AI -ontdekking als een imperatief voor bestuur

Een AI Asset Inventory is een wettelijke vereiste en geen aardige te hebben. Kaders zoals de EU AI -wet verplichten expliciet organisaties om de zichtbaarheid te behouden in de gebruikte AI -systemen, omdat er zonder ontdekking geen inventaris is en zonder inventaris geen bestuur kan zijn. Shadow AI is een belangrijk onderdeel hiervan.

Verschillende AI -tools vormen verschillende risico’s. Sommigen kunnen stilletjes trainen op eigen gegevens, anderen kunnen gevoelige informatie opslaan in rechtsgebieden zoals China, waardoor de blootstelling aan intellectuele eigendom ontstaat. Om te voldoen aan de voorschriften en het bedrijf te beschermen, moeten beveiligingsleiders eerst de volledige reikwijdte van het AI -gebruik ontdekken, over bestemde bedrijfsrekeningen en niet -gesanctioneerde persoonlijke.

Eenmaal gewapend met deze zichtbaarheid, kunnen organisaties cases met laag risico scheiden van die met gevoelige gegevens, gereguleerde workflows of geografische blootstelling. Alleen dan kunnen ze een zinvol bestuursbeleid afdwingen dat zowel gegevens beschermen als de productiviteit van werknemers mogelijk maakt.

Hoe harmonische beveiliging helpt

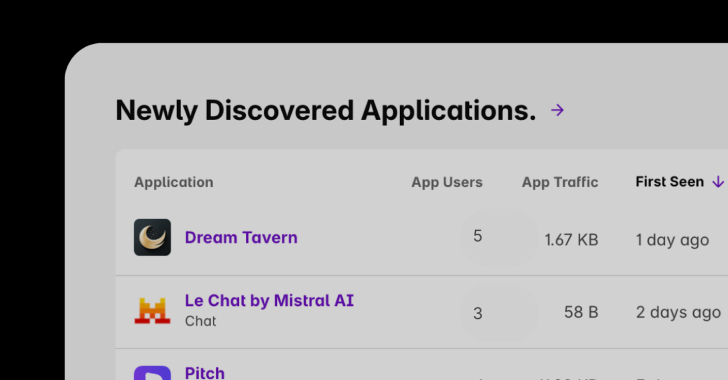

Harmonische beveiliging maakt deze aanpak mogelijk door inlichtingencontroles te leveren voor het gebruik van werknemers van AI. Dit omvat continue monitoring van schaduw AI, met kant-en-klare risicobeoordelingen voor elke toepassing.

In plaats van te vertrouwen op statische bloklijsten, biedt Harmonic zichtbaarheid in zowel gesanctioneerde als niet -gesanctioneerde AI -gebruik, past vervolgens een slim beleid toe op basis van de gevoeligheid van de gegevens, de rol van de werknemer en de aard van de tool.

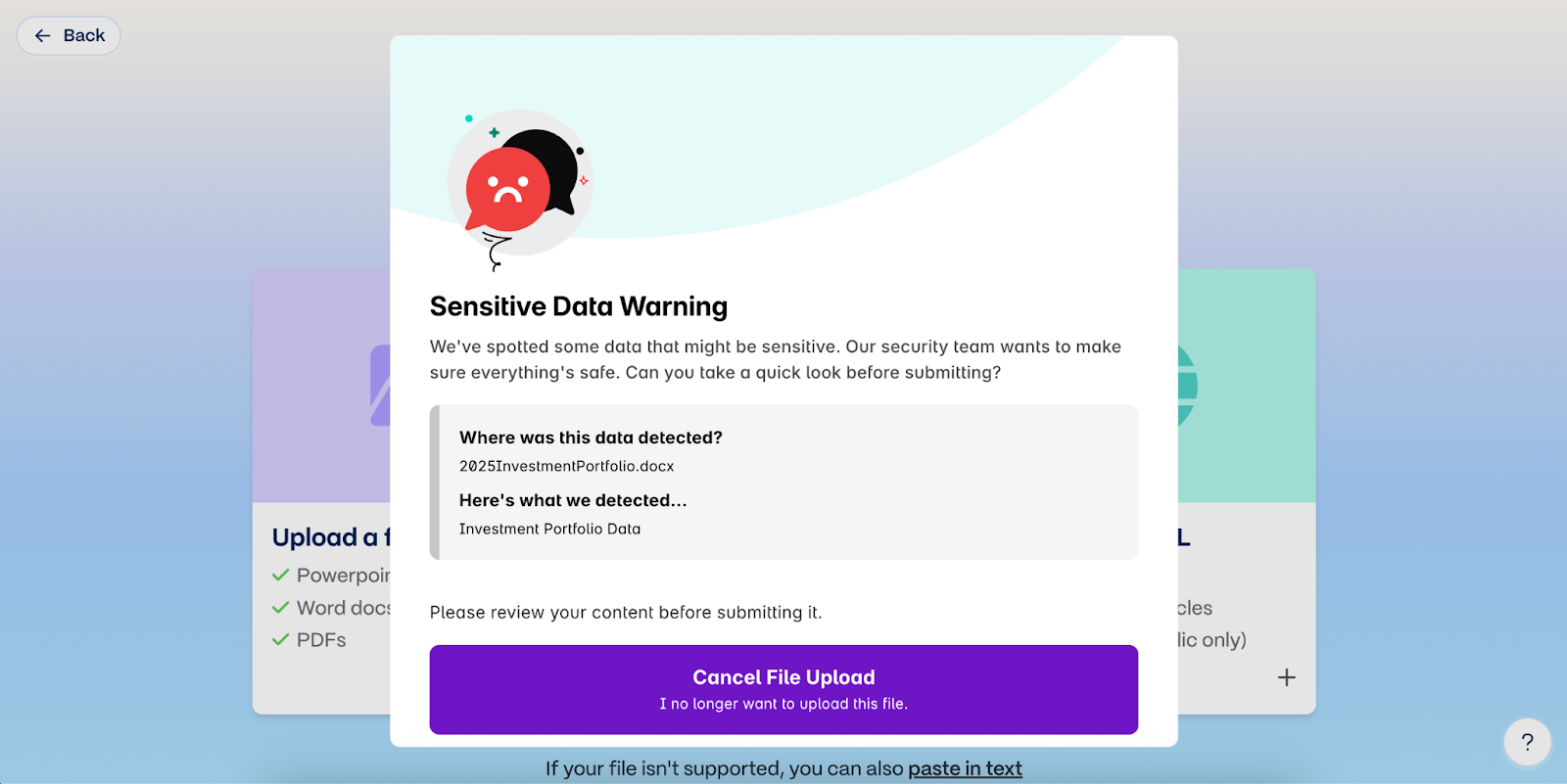

Dat betekent dat een marketingteam mogelijk is toegestaan om specifieke informatie in specifieke tools voor het maken van inhoud te plaatsen, terwijl HR- of juridische teams worden beperkt om persoonlijke accounts te gebruiken voor gevoelige werknemersinformatie. Dit wordt ondersteund door modellen die informatie kunnen identificeren en classificeren terwijl werknemers de gegevens delen. Dit stelt teams in staat om het AI -beleid af te dwingen met de nodige precisie.

Het pad vooruit

Shadow AI is hier om te blijven. Naarmate meer SaaS -toepassingen AI insluiten, wordt niet -beheerd gebruik alleen maar uitgebreid. Organisaties die vandaag niet aan de ontdekking aanpakken, zullen zich morgen niet in staat zijn om te regeren.

Het pad vooruit is om het intelligent te regeren in plaats van het te blokkeren. Shadow AI Discovery geeft CISO’s de zichtbaarheid die ze nodig hebben om gevoelige gegevens te beschermen, aan de wettelijke vereisten te voldoen en werknemers in staat te stellen veilig te profiteren van de productiviteitsuitkeringen van AI.

Harmonische veiligheid helpt ondernemingen al om deze volgende stap in AI -governance te zetten.

Voor cisos is het niet langer een vraag of werknemers Shadow AI gebruiken … het is of je het kunt zien.