OpenAI heeft de lancering aangekondigd van een “agentische beveiligingsonderzoeker” die wordt aangedreven door zijn GPT-5 grote taalmodel (LLM) en is geprogrammeerd om een menselijke expert te emuleren die in staat is code te scannen, te begrijpen en te patchen.

Genaamd AardvarkenVolgens het bedrijf voor kunstmatige intelligentie (AI) is de autonome agent ontworpen om ontwikkelaars en beveiligingsteams te helpen beveiligingskwetsbaarheden op grote schaal te signaleren en op te lossen. Het is momenteel beschikbaar in privébèta.

“Aardvark analyseert voortdurend broncoderepository’s om kwetsbaarheden te identificeren, de exploiteerbaarheid te beoordelen, prioriteit te geven aan de ernst en gerichte patches voor te stellen”, aldus OpenAI.

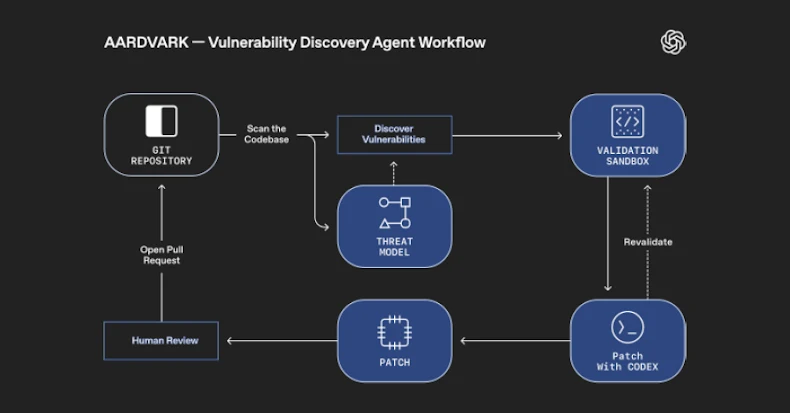

Het werkt door zichzelf in te bedden in de softwareontwikkelingspijplijn, door commits en wijzigingen in codebases te monitoren, beveiligingsproblemen op te sporen en hoe deze kunnen worden uitgebuit, en oplossingen voor te stellen om deze aan te pakken met behulp van op LLM gebaseerde redenering en toolgebruik.

De agent wordt aangedreven door GPT-5, dat OpenAI in augustus 2025 introduceerde. Het bedrijf beschrijft het als een ‘slim, efficiënt model’ met diepere redeneermogelijkheden, dankzij het GPT-5-denken, en een ‘real-time router’ om te beslissen welk model het juiste is om te gebruiken op basis van het gesprekstype, de complexiteit en de intentie van de gebruiker.

Aardvark, zo voegt OpenAI eraan toe, analyseert de codebasis van een project om een dreigingsmodel te produceren dat volgens hem het beste de beveiligingsdoelstellingen en het ontwerp ervan weerspiegelt. Met deze contextuele basis scant de agent vervolgens zijn geschiedenis om bestaande problemen te identificeren, maar ook om nieuwe problemen te detecteren door inkomende wijzigingen in de repository nauwkeurig te onderzoeken.

Zodra een potentieel beveiligingsfout wordt gevonden, probeert het dit in een geïsoleerde, sandbox-omgeving te activeren om de exploiteerbaarheid ervan te bevestigen en maakt het gebruik van OpenAI Codex, de coderingsagent, om een patch te produceren die door een menselijke analist kan worden beoordeeld.

OpenAI zei dat het de agent in de interne codebases van OpenAI en enkele van zijn externe alfapartners heeft gebruikt, en dat het heeft geholpen bij het identificeren van ten minste tien CVE’s in open-sourceprojecten.

De AI-parvenu is verre van het enige bedrijf dat AI-agenten uitprobeert om geautomatiseerde detectie en patching van kwetsbaarheden aan te pakken. Eerder deze maand kondigde Google CodeMender aan dat het kwetsbare code zou detecteren, patchen en herschrijven om toekomstige exploits te voorkomen. De technologiegigant merkte ook op dat het van plan is samen te werken met beheerders van cruciale open-sourceprojecten om door CodeMender gegenereerde patches te integreren om projecten veilig te houden.

In dat licht bezien worden Aardvark, CodeMender en XBOW gepositioneerd als tools voor continue codeanalyse, exploitvalidatie en patchgeneratie. Het komt ook dicht in de buurt van OpenAI’s release van de gpt-oss-safeguard-modellen die zijn afgestemd op veiligheidsclassificatietaken.

“Aardvark vertegenwoordigt een nieuw ‘defender-first’-model: een agentische beveiligingsonderzoeker die samenwerkt met teams door continue bescherming te bieden naarmate de code evolueert”, aldus OpenAI. “Door kwetsbaarheden vroegtijdig op te sporen, de exploiteerbaarheid in de echte wereld te valideren en duidelijke oplossingen aan te bieden, kan Aardvark de beveiliging versterken zonder de innovatie te vertragen. Wij geloven in het uitbreiden van de toegang tot beveiligingsexpertise.”