Sinds de lancering van ChatGPT in 2022 heeft OpenAI de verwachtingen overtroffen met een gestage stroom van productaankondigingen en verbeteringen. Een dergelijke aankondiging kwam op 16 mei 2024 en voor de meeste consumenten voelde het waarschijnlijk onschuldig. Getiteld “Verbeteringen in gegevensanalyse in ChatGPT,” de post schetst hoe gebruikers bestanden rechtstreeks vanuit Google Drive en Microsoft OneDrive kunnen toevoegen. Het is de moeite waard om te vermelden dat andere genAI-tools zoals Google AI Studio en Claude Enterprise onlangs ook soortgelijke mogelijkheden hebben toegevoegd. Best geweldig, toch? Misschien.

Wanneer u het Google Drive- of OneDrive-account van uw organisatie koppelt aan ChatGPT (of andere genAI-tools), verleent u het uitgebreide machtigingen voor niet alleen uw persoonlijke bestanden, maar ook voor resources op uw gehele gedeelde schijf. Zoals u zich kunt voorstellen, gaan de voordelen van dit soort uitgebreide integratie gepaard met een scala aan cybersecurity-uitdagingen.

Dus hoe kom je erachter of werknemers de integratie tussen ChatGPT en Google Drive hebben ingeschakeld, en hoe kun je controleren welke bestanden zijn geopend? Deze post laat zien hoe je dit native kunt doen in Google Workspace, en hoe Nudge Security je kan helpen alle genAI-apps te ontdekken die in gebruik zijn, en met welke andere apps ze zijn geïntegreerd.

Waar u ChatGPT-activiteit in Google Workspace kunt zien

In Google Workspace zijn er een aantal manieren om activiteit die verband houdt met de ChatGPT-verbinding te identificeren en onderzoeken.

Navigeer vanuit de Admin Console van Google Workspace naar Rapportage > Controle en onderzoek > Drive-logboekgebeurtenissen. Hier ziet u een lijst met geopende Google Drive-resources.

U kunt de activiteit ook onderzoeken via API-aanroepen onder Rapportage → Controle en onderzoek → OAuth-logboekgebeurtenissen.

Dus, door regelmatig uw Google Workspace-beheerconsole te controleren, kunt u begrijpen welke resources worden gebruikt door ChatGPT, maar deze activiteit zien nadat deze al heeft plaatsgevonden, is natuurlijk minder waardevol dan gewaarschuwd worden zodra er nieuwe integraties worden gemaakt met ChatGPT. Dit is waar Nudge Security kan helpen.

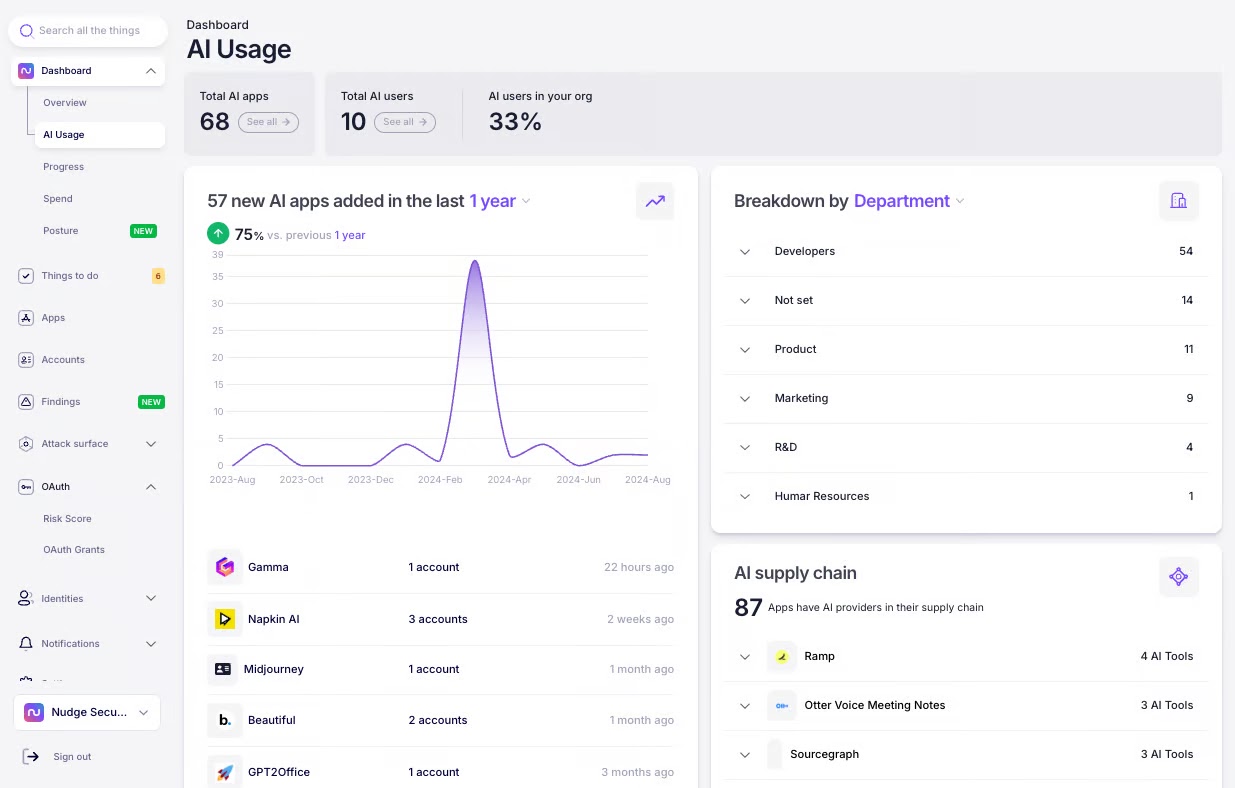

Hoe u alle genAI-integraties met Nudge Security kunt bekijken

Nudge Security ontdekt alle accounts die ooit door iemand in uw organisatie zijn aangemaakt voor een SaaS-applicatie, inclusief ChatGPT en de snel groeiende lijst met nieuw gecreëerde genAI-tools, zonder dat er enige voorkennis van het bestaan van de tool nodig is. Met het ingebouwde AI-dashboard kunnen klanten op de hoogte blijven van AI-adoptie en proactief AI-beveiligingsrisico’s beperken.

Bovendien toont Nudge Security de OAuth-toekenningen van uw gehele organisatie, zoals die toegekend aan ChatGPT, in een filterbaar OAuth-dashboard met daarin het type toekenning (aanmelden of integratie), activiteit en risico-inzichten. Filter op categorie om alle toekenningen te zien die gekoppeld zijn aan AI-tools:

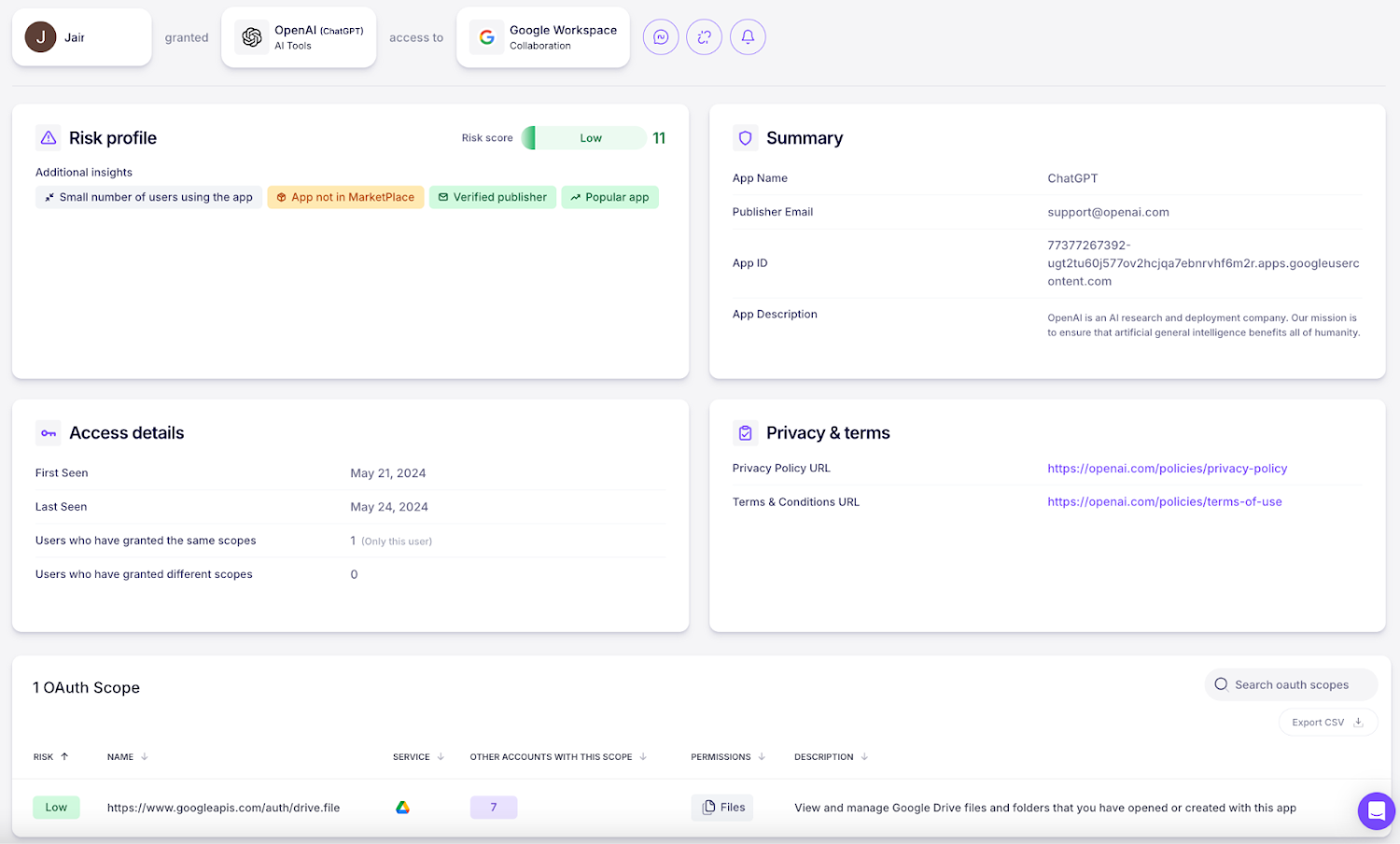

Klik op een subsidie om een detailscherm te openen. Hier kunt u een risicoprofiel bekijken, informatie over wie de subsidie heeft verstrekt en wanneer, toegang krijgen tot details, toegekende scopes en meer:

Vervolgens kunt u via Slack of e-mail een ‘nudge’ sturen naar de maker van de subsidie om een bepaalde actie te ondernemen, zoals het beperken van de reikwijdte van de subsidie. U kunt de subsidie ook direct intrekken via de gebruikersinterface van Nudge Security.

Tot slot kunt u een aangepaste regel instellen om ervoor te zorgen dat u op de hoogte wordt gesteld wanneer een gebruiker in uw organisatie een OAuth-toekenning voor ChatGPT aanmaakt, of voor een andere genAI-app. U kunt ook regels maken om onmiddellijk te worden gewaarschuwd wanneer er nieuwe genAI-accounts worden aangemaakt, en nieuwe genAI-gebruikers aansporen om uw genAI-beleid voor acceptabel gebruik te bekijken en te erkennen.

Productiviteit in evenwicht brengen met veiligheid

Hoewel de integratie van ChatGPT met Google Drive en Microsoft OneDrive een enorm potentieel biedt voor het verbeteren van de productiviteit, opent het ook de deur naar aanzienlijke beveiligingsrisico’s. Organisaties moeten deze integraties benaderen met een duidelijk begrip van de potentiële risico’s en de juiste governance- en beveiligingsmaatregelen implementeren om deze te beperken.

Nudge Security biedt inzicht, context en automatisering, zodat bedrijven genAI-tools kunnen implementeren zonder dat dit ten koste gaat van de gegevensbeveiliging.

Start een gratis proefperiode van 14 dagen Ontdek vandaag nog alle genAI-apps die ooit in uw organisatie zijn geïntroduceerd, inclusief alle integraties met uw andere applicaties.