Het onlangs ontdekte geavanceerde Linux-malwareframework bekend als VoidLink wordt geacht te zijn ontwikkeld door één persoon met behulp van een kunstmatige intelligentie (AI)-model.

Dat blijkt uit nieuwe bevindingen van Check Point Research, dat operationele beveiligingsblunders van de auteur van de malware heeft geïdentificeerd en aanwijzingen heeft gegeven voor de ontwikkelingsoorsprong ervan. Het nieuwste inzicht maakt VoidLink tot een van de eerste exemplaren van geavanceerde malware die grotendeels met behulp van AI is gegenereerd.

“Deze materialen leveren duidelijk bewijs dat de malware voornamelijk werd geproduceerd via AI-gestuurde ontwikkeling en binnen een week een eerste functioneel implantaat bereikte”, aldus het cyberbeveiligingsbedrijf, eraan toevoegend dat het begin december 2025 meer dan 88.000 regels code had bereikt.

VoidLink, vorige week voor het eerst publiekelijk gedocumenteerd, is een feature-rijk malwareframework geschreven in Zig dat speciaal is ontworpen voor langdurige, sluipende toegang tot op Linux gebaseerde cloudomgevingen. De malware zou afkomstig zijn uit een aan China gelieerde ontwikkelomgeving. Op het moment van schrijven blijft het exacte doel van de malware onduidelijk. Tot nu toe zijn er geen echte infecties waargenomen.

Een vervolganalyse van Sysdig was de eerste die het feit benadrukte dat de toolkit mogelijk is ontwikkeld met behulp van een groot taalmodel (LLM) onder leiding van een mens met uitgebreide kennis van kernelontwikkeling en rode teamervaring, waarbij vier verschillende bewijsstukken werden aangehaald:

- Overmatig systematische debug-uitvoer met perfect consistente opmaak in alle modules

- Placeholder-gegevens (“John Doe”) zijn typerend voor LLM-trainingsvoorbeelden die zijn ingebed in lokantwoordsjablonen

- Uniform API-versiebeheer waarbij alles _v3 is (bijv. BeaconAPI_v3, docker_escape_v3, timestomp_v3)

- Sjabloonachtige JSON-antwoorden die elk mogelijk veld bestrijken

“Het meest waarschijnlijke scenario: een bekwame Chineessprekende ontwikkelaar gebruikte AI om de ontwikkeling te versnellen (het genereren van boilerplate, debug logging, JSON-sjablonen) terwijl hij zelf de beveiligingsexpertise en architectuur leverde”, merkte de cloudbeveiligingsleverancier eind vorige week op.

Het rapport van Check Point van dinsdag ondersteunt deze hypothese en stelt dat het artefacten heeft geïdentificeerd die suggereren dat de ontwikkeling op zichzelf is ontwikkeld met behulp van een AI-model, dat vervolgens werd gebruikt om het raamwerk te bouwen, uit te voeren en te testen – waardoor wat een concept was, effectief werd omgezet in een werkend hulpmiddel binnen een versnelde tijdlijn.

“De algemene aanpak voor het ontwikkelen van VoidLink kan worden omschreven als Spec Driven Development (SDD)”, aldus het rapport. “In deze workflow begint een ontwikkelaar met het specificeren van wat hij of zij bouwt, maakt vervolgens een plan, verdeelt dat plan in taken en laat een agent het pas daarna implementeren.”

Er wordt aangenomen dat de bedreigingsacteur eind november 2025 met zijn werkzaamheden aan de VoidLink begon, waarbij hij een codeeragent gebruikte die bekend staat als TRAE SOLO om de taken uit te voeren. Deze beoordeling is gebaseerd op de aanwezigheid van door TRAE gegenereerde helperbestanden die samen met de broncode naar de server van de bedreigingsacteur zijn gekopieerd en later zijn gelekt in een blootgestelde open directory.

Bovendien zei Check Point dat het intern planningsmateriaal had ontdekt dat in het Chinees was geschreven en betrekking had op sprintschema’s, functie-uitsplitsingen en coderingsrichtlijnen die alle kenmerken hadden van door LLM gegenereerde inhoud: goed gestructureerd, consistent opgemaakt en minutieus gedetailleerd. Eén zo’n document met details over het ontwikkelingsplan werd op 27 november 2025 opgesteld.

De documentatie zou zijn hergebruikt als uitvoeringsblauwdruk voor de LLM om de malware te volgen, bouwen en testen. Check Point, dat de implementatieworkflow repliceerde met behulp van de TRAE IDE die door de ontwikkelaar werd gebruikt, ontdekte dat het model code genereerde die leek op de broncode van VoidLink.

“Een beoordeling van de codestandaardisatie-instructies ten opzichte van de herstelde VoidLink-broncode toont een opvallend niveau van afstemming”, aldus het rapport. “Conventies, structuur en implementatiepatronen komen zo nauw overeen dat er weinig ruimte voor twijfel overblijft: de codebase is volgens die exacte instructies geschreven.”

De ontwikkeling is wederom een teken dat, ook al voorzien AI en LLM’s slechte actoren misschien niet van nieuwe mogelijkheden, ze de barrière voor toegang tot cybercriminaliteit verder kunnen verlagen, waardoor zelfs één individu in staat wordt gesteld om snel complexe systemen voor te stellen, te creëren en te herhalen en geavanceerde aanvallen uit te voeren – waardoor een proces wordt gestroomlijnd dat ooit een proces was dat een aanzienlijke hoeveelheid inspanning en middelen vergde en alleen beschikbaar was voor tegenstanders van de natiestaten.

“VoidLink vertegenwoordigt een echte verandering in de manier waarop geavanceerde malware kan worden gemaakt. Wat opviel was niet alleen de verfijning van het raamwerk, maar ook de snelheid waarmee het werd gebouwd”, zegt Eli Smadja, groepsmanager bij Check Point Research, in een verklaring gedeeld met The Hacker News.

“AI heeft wat lijkt op één enkele actor in staat gesteld om binnen enkele dagen een complex malwareplatform te plannen, ontwikkelen en itereren – iets waarvoor voorheen gecoördineerde teams en aanzienlijke middelen nodig waren. Dit is een duidelijk signaal dat AI de economie en de omvang van cyberdreigingen verandert.”

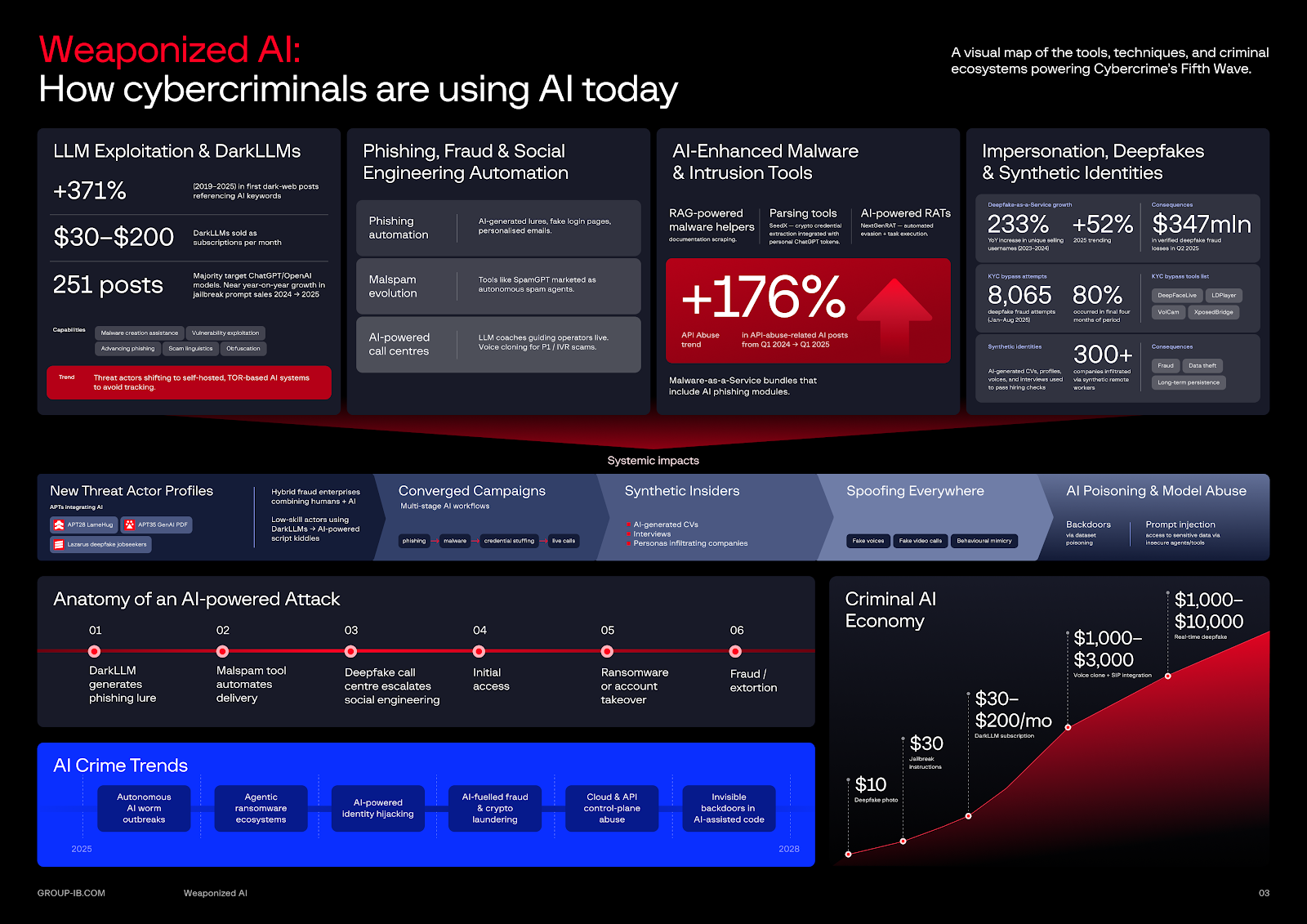

In een whitepaper die deze week werd gepubliceerd, beschreef Group-IB AI als een ‘vijfde golf’ in de evolutie van cybercriminaliteit, die kant-en-klare tools biedt om geavanceerde aanvallen mogelijk te maken. “Tegenstanders industrialiseren AI, waardoor specialistische vaardigheden zoals overreding, nabootsing van identiteit en de ontwikkeling van malware worden omgezet in on-demand diensten die beschikbaar zijn voor iedereen met een creditcard”, aldus het rapport.

Het in Singapore gevestigde cyberbeveiligingsbedrijf merkte op dat posts op dark web-forums met AI-trefwoorden sinds 2019 met 371% zijn toegenomen, waarbij bedreigingsactoren reclame maken voor duistere LLM’s zoals Nytheon AI die geen ethische beperkingen kennen, jailbreak-frameworks en synthetische identiteitskits die AI-video-acteurs, gekloonde stemmen en zelfs biometrische datasets aanbieden voor slechts $ 5.

“AI heeft de cybercriminaliteit geïndustrialiseerd. Wat ooit bekwame operators en tijd vereiste, kan nu wereldwijd worden gekocht, geautomatiseerd en opgeschaald”, zegt Craig Jones, voormalig directeur cybercriminaliteit van INTERPOL en onafhankelijk strategisch adviseur.

“Hoewel AI geen nieuwe motieven voor cybercriminelen heeft gecreëerd – geld, macht en toegang bepalen nog steeds het ecosysteem – heeft het de snelheid, schaal en verfijning waarmee deze motieven worden nagestreefd dramatisch vergroot.”