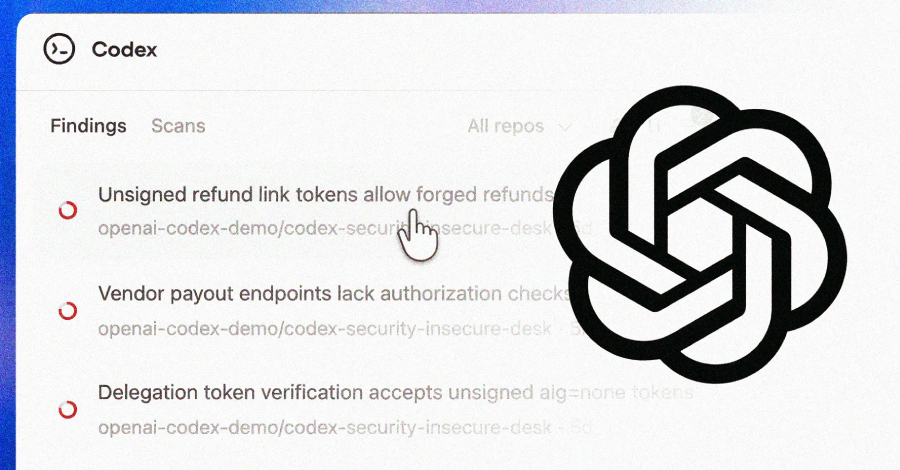

OpenAI is vrijdag begonnen met de uitrol Codex-beveiligingeen door kunstmatige intelligentie (AI) aangedreven beveiligingsagent die is ontworpen om kwetsbaarheden te vinden, valideren en oplossingen voor te stellen.

De functie is beschikbaar in een onderzoekspreview voor ChatGPT Pro-, Enterprise-, Business- en Edu-klanten via het Codex-web met gratis gebruik gedurende de volgende maand.

“Het bouwt een diepgaande context over uw project op om complexe kwetsbaarheden te identificeren die andere agentische tools over het hoofd zien, waardoor bevindingen met meer vertrouwen naar boven komen met oplossingen die de beveiliging van uw systeem op betekenisvolle wijze verbeteren en u tegelijkertijd behoeden voor het lawaai van onbeduidende bugs”, aldus het bedrijf.

Codex Security vertegenwoordigt een evolutie van Aardvark, dat OpenAI in oktober 2025 in een privébèta onthulde als een manier voor ontwikkelaars en beveiligingsteams om beveiligingskwetsbaarheden op schaal te detecteren en op te lossen.

De afgelopen 30 dagen heeft Codex Security in de loop van de bèta ruim 1,2 miljoen commits in externe opslagplaatsen gescand, waarbij 792 kritische bevindingen en 10.561 zeer ernstige bevindingen zijn geïdentificeerd. Deze omvatten kwetsbaarheden in verschillende open-sourceprojecten zoals onder meer OpenSSH, GnuTLS, GOGS, Thorium, libssh, PHP en Chromium. Sommigen van hen zijn hieronder opgesomd –

- GnuPG – CVE-2026-24881, CVE-2026-24882

- GnuTLS – CVE-2025-32988, CVE-2025-32989

- GOGS-CVE-2025-64175, CVE-2026-25242

- Thorium-CVE-2025-35430, CVE-2025-35431, CVE-2025-35432, CVE-2025-35433, CVE-2025-35434, CVE-2025-35435, CVE-2025-35436

Volgens het AI-bedrijf maakt de nieuwste versie van de applicatiebeveiligingsagent gebruik van de redeneermogelijkheden van zijn grensmodellen en combineert deze met geautomatiseerde validatie om het risico op valse positieven te minimaliseren en bruikbare oplossingen te bieden.

De scans van OpenAI op dezelfde repository’s hebben in de loop van de tijd een toenemende nauwkeurigheid en een dalend aantal valse positieven laten zien, waarbij de laatste in alle repository’s met meer dan 50% is gedaald.

In een verklaring gedeeld met The Hacker News zegt OpenAI dat Codex Security is ontworpen om de signaal-ruisverhouding te verbeteren door het ontdekken van kwetsbaarheden in de systeemcontext te baseren en bevindingen te valideren voordat ze aan gebruikers worden getoond.

Concreet werkt de agent in drie stappen: hij analyseert een repository om grip te krijgen op de beveiligingsrelevante systeemstructuur van het project en genereert een bewerkbaar dreigingsmodel dat vastlegt wat het doet en waar het het meest kwetsbaar is.

Zodra de systeemcontext is opgebouwd, gebruikt Codex Security deze als basis om kwetsbaarheden te identificeren en bevindingen te classificeren op basis van hun impact in de echte wereld. De gemarkeerde problemen worden in een sandbox-omgeving onder druk getest om ze te valideren.

“Wanneer Codex Security is geconfigureerd met een omgeving die is afgestemd op uw project, kan het potentiële problemen rechtstreeks in de context van het draaiende systeem valideren”, aldus OpenAI. “Die diepere validatie kan het aantal valse positieven nog verder verminderen en het creëren van werkende proofs-of-concept mogelijk maken, waardoor beveiligingsteams sterker bewijsmateriaal krijgen en een duidelijker pad naar herstel kunnen volgen.”

In de laatste fase stelt de agent oplossingen voor die het beste aansluiten bij het systeemgedrag, zodat regressies worden verminderd en deze gemakkelijker kunnen worden beoordeeld en geïmplementeerd.

Het nieuws over Codex Security komt weken nadat Anthropic Claude Code Security heeft gelanceerd om gebruikers te helpen een softwarecodebase te scannen op kwetsbaarheden en patches voor te stellen.