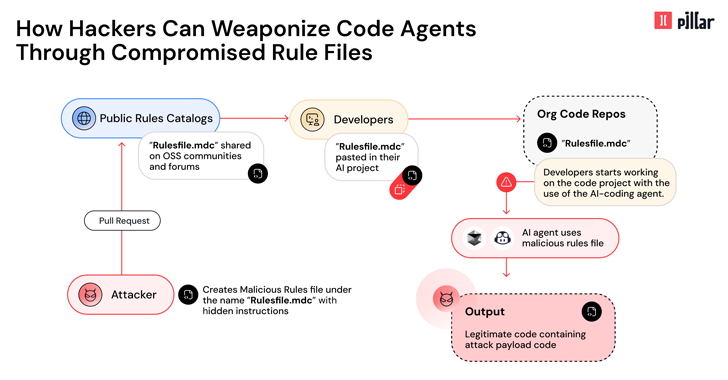

Onderzoekers van cybersecurity hebben details bekendgemaakt van een nieuwe aanvalsaanval Vector Nages-regels Backdoor die van invloed is op kunstmatige intelligentie (AI) -gestuurde code-editors zoals GitHub Copilot en Cursor, waardoor ze kwaadwillende code injecteerden.

“Met deze techniek kunnen hackers de AI-gegenereerde code stilletjes compromitteren door verborgen kwaadaardige instructies te injecteren in schijnbaar onschuldige configuratiebestanden die worden gebruikt door Cursor en Github Copilot,” zei mede-oprichter van Pillar Security en CTO Ziv Karliner in een technisch rapport dat werd gedeeld met het hacker-nieuws.

“Door verborgen unicode -tekens en geavanceerde ontwijkingstechnieken te exploiteren in het model dat wordt geconfronteerd met instructie -lading, kunnen bedreigingsacteurs de AI manipuleren om kwaadaardige code in te voegen die typische codevezieningen omzeilt.”

De aanvalsvector is opmerkelijk voor het feit dat hij schadelijke code mogelijk maakt om zich in stilte te verspreiden over projecten, waardoor een supply chain -risico met zich meebrengt.

De kern van de aanval hangt af van de regelsbestanden die door AI -agenten worden gebruikt om hun gedrag te begeleiden, waardoor gebruikers de beste coderingspraktijken en projectarchitectuur kunnen definiëren.

In het bijzonder omvat het insluiting van zorgvuldig vervaardigde aanwijzingen in schijnbaar goedaardige regelbestanden, waardoor het AI -tool code genereert met beveiligingskwetsbaarheden of achterdeuren. Met andere woorden, de vergiftigde regels duwen de AI in om snode code te produceren.

Dit kan worden bereikt door het gebruik van nul-breedte-schrijnwerkers, bidirectionele tekstmarkeringen en andere onzichtbare karakters om kwaadaardige instructies te verbergen en het vermogen van de AI te exploiteren om de natuurlijke taal te interpreteren om kwetsbare code te genereren via semantische patronen die het model misleiden tot een overhangende ethische en veiligheidsbeperkingen.

Na verantwoorde openbaarmaking eind februari en maart 2024 hebben zowel Cursor als Gihub verklaard dat gebruikers verantwoordelijk zijn voor het beoordelen en accepteren van suggesties die door de tools zijn gegenereerd.

“‘Regelsbestand Backdoor’ vormt een aanzienlijk risico door de AI zelf te bewapenen als een aanvalsvector, waardoor de meest vertrouwde assistent van de ontwikkelaar effectief een onwetende medeplichtige wordt omgezet, die mogelijk miljoenen eindgebruikers beïnvloedt door middel van gecompromitteerde software,” zei Karliner.

“Zodra een vergiftigd regelbestand is opgenomen in een projectrepository, beïnvloedt dit alle toekomstige code-generatiesessies door teamleden. Bovendien overleven de kwaadaardige instructies vaak projectvork, waardoor een vector wordt gecreëerd voor supply chain-aanvallen die stroomafwaartse afhankelijkheden en eindgebruikers kunnen beïnvloeden.”