Microsoft heeft een nieuwe update aangekondigd voor het Azure AI-platform. Het omvat systemen voor het detecteren en beperken van hallucinaties en kwaadaardige aanvallen. Azure AI-klanten hebben nu toegang tot nieuwe, op LLM gebaseerde tools die het beschermingsniveau tegen ongewenste of onbedoelde reacties in hun AI-toepassingen aanzienlijk verbeteren.

Microsoft versterkt de Azure AI-verdediging met detectie van hallucinaties en kwaadaardige aanvallen

Sarah Bird, Microsoft's Chief Product Officer of Responsible AI, legt uit dat deze veiligheidsvoorzieningen de ‘gemiddelde’ Azure-gebruiker zullen beschermen die misschien niet gespecialiseerd is in het identificeren of oplossen van AI-kwetsbaarheden. TheVerge heeft er uitgebreid op ingegaan en ontging hoe deze nieuwe tools potentiële kwetsbaarheden kunnen identificeren, hallucinaties kunnen monitoren en kwaadaardige aanwijzingen in realtime kunnen blokkeren. Organisaties zullen waardevol inzicht krijgen in de prestaties en veiligheid van hun AI-modellen.

Deze functies omvatten Prompt Shields om snelle injecties/kwaadwillige prompts te voorkomen, Groundedness Detection voor de identificatie van hallucinaties en veiligheidsevaluaties die de kwetsbaarheid van modellen beoordelen. Hoewel Azure AI deze kenmerken al in preview heeft, zullen andere functionaliteiten, zoals het sturen van modellen naar veilige uitvoer of het volgen van potentieel problematische gebruikers, in toekomstige releases verschijnen.

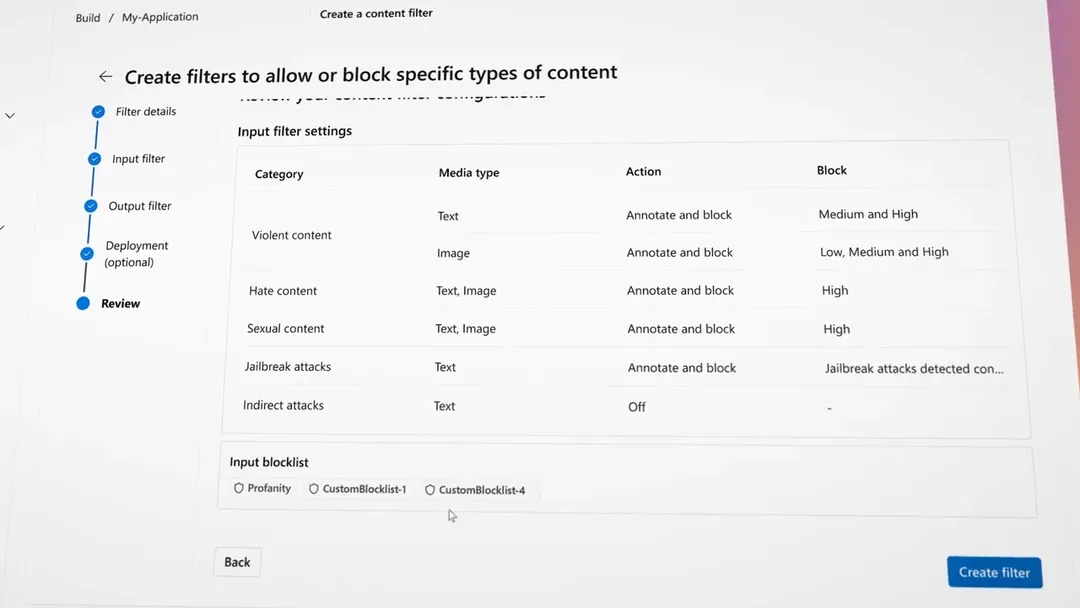

Eén ding dat de aanpak van Microsoft onderscheidt, is de nadruk op aangepaste controle, waarmee Azure-gebruikers kunnen schakelen tussen filters voor haatzaaiende uitlatingen of geweld in AI-modellen. Dit helpt bij het voorkomen van zorgen over vooringenomenheid of ongepaste inhoud, waardoor gebruikers de veiligheidsinstellingen kunnen aanpassen aan hun specifieke vereisten.

Het monitoringsysteem controleert prompts en antwoorden op verboden woorden of verborgen prompts voordat ze worden doorgegeven aan het model voor verwerking. Dit elimineert alle kansen dat AI outputs produceert die in strijd zijn met de gewenste veiligheids- en ethische normen en als gevolg daarvan betwiste of schadelijke materialen genereert.

Azure AI concurreert nu met GPT-4 en Llama 2 op het gebied van veiligheid en bescherming

Hoewel deze veiligheidsvoorzieningen direct beschikbaar zijn bij populaire modellen zoals GPT-4 en Llama 2, kan het zijn dat degenen die kleinere of minder bekende open-source AI-systemen gebruiken, deze handmatig in hun modellen moeten integreren. Niettemin toont de toewijding van Microsoft aan het verbeteren van de veiligheid en beveiliging van AI haar toewijding aan het leveren van robuuste en betrouwbare AI-oplossingen op Azure.

De inspanningen van Microsoft om de veiligheid te verbeteren tonen een groeiende belangstelling voor het verantwoorde gebruik van AI-technologie. Microsoft streeft daarom naar het creëren van een veiligere omgeving waarin klanten risico's kunnen detecteren en voorkomen voordat ze zich voordoen, terwijl ze het AI-ecosysteem in Azure gebruiken.