Microsoft heeft een open access-automatiseringsframework uitgebracht genaamd PyRIT (afkorting van Python Risk Identification Tool) om proactief risico’s in generatieve kunstmatige intelligentie (AI)-systemen te identificeren.

De red teaming-tool is ontworpen om “elke organisatie over de hele wereld in staat te stellen verantwoord te innoveren met de nieuwste ontwikkelingen op het gebied van kunstmatige intelligentie”, zegt Ram Shankar Siva Kumar, AI red team lead bij Microsoft.

Het bedrijf zei dat PyRIT kan worden gebruikt om de robuustheid van eindpunten van grote taalmodellen (LLM) te beoordelen tegen verschillende schadecategorieën zoals verzinsel (bijvoorbeeld hallucinaties), misbruik (bijvoorbeeld vooringenomenheid) en verboden inhoud (bijvoorbeeld intimidatie).

Het kan ook worden gebruikt om beveiligingsschade te identificeren, variërend van het genereren van malware tot jailbreaken, maar ook privacyschade zoals identiteitsdiefstal.

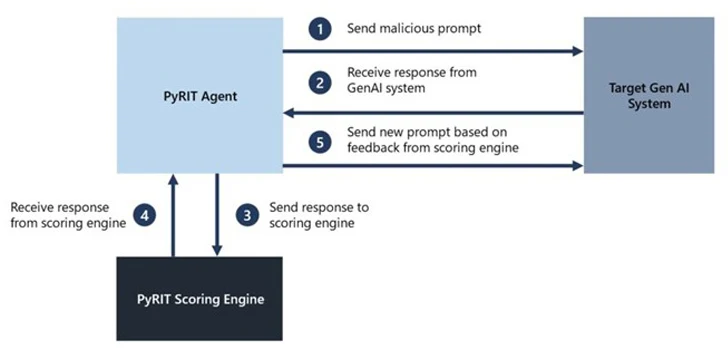

PyRIT wordt geleverd met vijf interfaces: doel, datasets, score-engine, de mogelijkheid om meerdere aanvalsstrategieën te ondersteunen en een geheugencomponent op te nemen die de vorm kan aannemen van JSON of een database om de tussenliggende invoer- en uitvoerinteracties op te slaan.

De scoringsengine biedt ook twee verschillende opties voor het scoren van de output van het doel-AI-systeem, waardoor red teamers een klassieke machine learning-classificator kunnen gebruiken of een LLM-eindpunt kunnen gebruiken voor zelfevaluatie.

“Het doel is om onderzoekers in staat te stellen een basislijn te hebben van hoe goed hun model en de volledige gevolgtrekkingspijplijn het doen tegen verschillende schadecategorieën en om die basislijn te kunnen vergelijken met toekomstige iteraties van hun model”, aldus Microsoft.

“Hierdoor kunnen ze over empirische gegevens beschikken over hoe goed hun model het vandaag de dag doet, en eventuele verslechtering van de prestaties detecteren op basis van toekomstige verbeteringen.”

Dat gezegd hebbende, benadrukt de technologiegigant zorgvuldig dat PyRIT geen vervanging is voor het handmatig red teaming van generatieve AI-systemen en dat het een aanvulling is op de bestaande domeinexpertise van een red team.

Met andere woorden, de tool is bedoeld om de ‘hotspots’ van het risico te benadrukken door aanwijzingen te genereren die kunnen worden gebruikt om het AI-systeem te evalueren en gebieden te markeren die verder onderzoek vereisen.

Microsoft erkende verder dat het combineren van generatieve AI-systemen vereist dat zowel de veiligheid als de verantwoordelijke AI-risico’s tegelijkertijd worden onderzocht en dat de oefening meer probabilistisch is, terwijl het ook wijst op de grote verschillen in generatieve AI-systeemarchitecturen.

“Handmatig sonderen, hoewel tijdrovend, is vaak nodig om potentiële blinde vlekken te identificeren,” zei Siva Kumar. “Automatisering is nodig voor opschaling, maar is geen vervanging voor handmatig sonderen.”

De ontwikkeling komt op het moment dat Protect AI meerdere kritieke kwetsbaarheden aan het licht bracht in populaire AI-toeleveringsketenplatforms zoals ClearML, Hugging Face, MLflow en Triton Inference Server, die zouden kunnen resulteren in het uitvoeren van willekeurige code en het vrijgeven van gevoelige informatie.