De groeiende rol van AI in bedrijfsomgevingen heeft de urgentie voor Chief Information Security Officers (CISO’s) verhoogd om effectief AI -bestuur te stimuleren. Als het gaat om elke opkomende technologie, is governance moeilijk – maar effectief bestuur is nog moeilijker. Het eerste instinct voor de meeste organisaties is om te reageren met rigide beleid. Schrijf een beleidsdocument, circuleer een reeks beperkingen en hoop dat het risico is opgenomen. Effectief bestuur werkt echter niet zo. Het moet een levend systeem zijn dat vormt hoe AI elke dag wordt gebruikt en organisaties begeleidt door veilige transformerende verandering zonder het tempo van innovatie te vertragen.

Voor CISO’s is het vinden van dat evenwicht tussen beveiliging en snelheid van cruciaal belang in het tijdperk van AI. Deze technologie biedt tegelijkertijd de grootste kans en de grootste risico -ondernemingen hebben geconfronteerd sinds het begin van het internet. Beweeg te snel zonder vangrails en gevoelige gegevens lekken in prompts, schaduw AI prolifereert of regulerende hiaten worden aansprakelijkheden. Beweeg te langzaam en concurrenten trekken vooruit met transformerende efficiëntie die te krachtig zijn om mee te concurreren. Beide pad komt met vertakkingen die cisos hun werk kunnen kosten.

Op hun beurt kunnen ze geen “afdeling van NO” leiden waar AI -adoptie -initiatieven worden belemmerd door de beveiligingsfunctie van de organisatie. Het is cruciaal om in plaats daarvan een pad te vinden naar ja, het in kaart brengen van governance aan organisatorische risicotolerantie en zakelijke prioriteiten, zodat de beveiligingsfunctie dient als een echte inkomsten enabler. In de loop van dit artikel zal ik drie componenten delen die Cisos kunnen helpen die verschuiving te maken en AI -governance -programma’s te stimuleren die veilige acceptatie op schaal mogelijk maken.

1. Begrijp wat er op de grond gebeurt

Toen Chatgpt voor het eerst arriveerde in november 2022, de meeste ciso’s die ik ken om een strikt beleid te publiceren dat werknemers vertelde wat ze niet moesten doen. Het kwam uit een plaats van positieve intentie, het overwegen van gevoelige gegevenslekkage was een legitieme zorg. Hoewel het beleid uit die “Document Backward” -benadering in theorie groot is, werken ze zelden in de praktijk. Vanwege hoe snel AI evolueert, moet AI-governance worden ontworpen door een “real-world forward” mindset die verklaart wat er echt op de grond binnen een organisatie gebeurt. Dit vereist dat CISO’s een fundamenteel begrip van AI hebben: de technologie zelf, waar het is ingebed, die SaaS -platforms het mogelijk maken, en hoe werknemers het gebruiken om hun klus te doen.

AI-voorraden, modelregisters en cross-functionele commissies klinken misschien als modewoorden, maar het zijn praktische mechanismen die beveiligingsleiders kunnen helpen deze AI-vloeiendheid te ontwikkelen. Een AI Bill of Materials (AIBOM) biedt bijvoorbeeld zichtbaarheid in de componenten, datasets en externe services die een AI -model zullen voeden. Net zoals een softwaremateriaal (SBOM) afhankelijkheden van derden verduidelijkt, zorgt een AIBOM ervoor dat leiders weten welke gegevens worden gebruikt, waar deze vandaan komen en welke het risico loopt het introduceert.

Modelregisters spelen een vergelijkbare rol voor AI -systemen die al in gebruik zijn. Ze volgen welke modellen worden geïmplementeerd, wanneer ze voor het laatst werden bijgewerkt, en hoe ze presteren om “Black Box Sprawl” te voorkomen en beslissingen te informeren over patching, ontmanteling of het schalen van gebruik. AI -commissies zorgen ervoor dat toezicht niet op de beveiliging valt of alleen. Vaak voorgezeten door een aangewezen AI -lead- of risicoofficier, omvatten deze groepen vertegenwoordigers van juridische, naleving, HR en bedrijfseenheden – het omzetten van governance van een siled richtlijn in een gedeelde verantwoordelijkheid die de bezorgdheid over de veiligheid over de zakelijke resultaten overbrugt.

2. Lijn beleid af op de snelheid van de organisatie

Zonder real-world forward-beleid vallen beveiligingsleiders vaak in de val van codificerende controles die ze niet realistisch kunnen leveren. Ik heb dit uit de eerste hand gezien door een CISO -collega van mij. Wetende werknemers experimenteerden al met AI, hij werkte om de verantwoordelijke acceptatie van verschillende GenAI -toepassingen in zijn personeelsbestand mogelijk te maken. Toen echter een nieuwe CIO bij de organisatie kwam en vond dat er te veel GenAI-toepassingen in gebruik waren, werd de CISO opgedragen om alle GenAI te verbieden totdat één bedrijfsbrede platform werd geselecteerd. Een jaar later snel vooruit, dat enkele platform was nog steeds niet geïmplementeerd en werknemers gebruikten niet -goedgekeurde Genai -tools die de organisatie blootstelden aan schaduw AI -kwetsbaarheden. De CISO zat vast en probeerde een algemene verbod af te dwingen dat hij niet kon uitvoeren, waardoor kritiek kon worden ingevoerd zonder de bevoegdheid om een werkbare oplossing te implementeren.

Dit soort scenario speelt zich af wanneer het beleid sneller wordt geschreven dan ze kunnen worden uitgevoerd, of wanneer ze niet kunnen anticiperen op het tempo van de adoptie van organisaties. Beleid dat op papier beslissend uitziet, kan snel verouderd raken als ze niet evolueren met leiderschapsveranderingen, ingebedde AI -functionaliteit en de organische manieren waarop werknemers nieuwe tools integreren in hun werk. Governance moet flexibel genoeg zijn om zich aan te passen, anders loopt het het risico beveiligingsteams te laten en het onmogelijke afdwingen.

De weg vooruit is het ontwerpen van beleid als levende documenten. Ze moeten evolueren zoals het bedrijf doet, geïnformeerd door daadwerkelijke use cases en afgestemd op meetbare resultaten. Governance kan ook niet stoppen bij het beleid; Het moet in stand komen in normen, procedures en basislijnen die dagelijks werk begeleiden. Alleen dan weten werknemers hoe veilige AI -adoptie er in de praktijk echt uitziet.

3. Maak AI Governance duurzaam

Zelfs met sterk beleid en routekaarten op hun plaats, blijven werknemers AI gebruiken op een manier die niet formeel zijn goedgekeurd. Het doel voor beveiligingsleiders zou niet moeten zijn om AI te verbieden, maar om verantwoordelijk gebruik de gemakkelijkste en meest aantrekkelijke optie te maken. Dat betekent dat ze werknemers uitrusten met AI-tools van enterprise-grade, of ze nu gekocht of van eigen bodem zijn, zodat ze niet hoeven te reiken naar onzekere alternatieven. Bovendien betekent dit het benadrukken en versterken van positief gedrag, zodat werknemers waarde zien bij het volgen van de vangrails in plaats van ze te omzeilen.

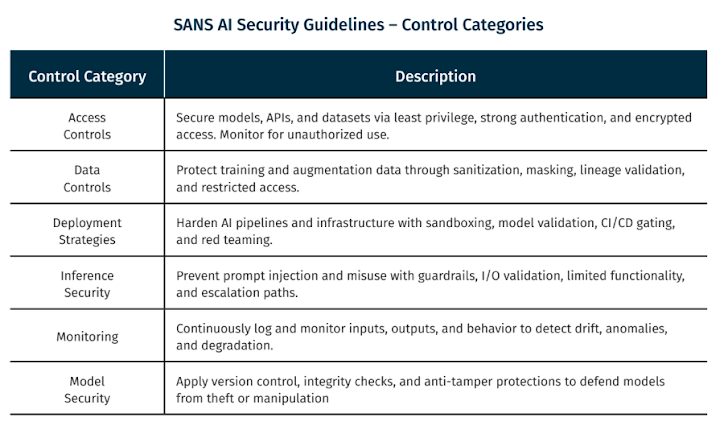

Duurzaam bestuur komt ook voort uit Gebruik maken van AI En AI beschermentwee pilaren van de Sans Institute’s onlangs gepubliceerde Secure AI Blueprint. Om AI effectief te regeren, moeten CISO’s hun SOC -teams in staat stellen AI effectief te gebruiken voor cyberverdediging – het automatiseren van geluidsreductie en verrijking, het valideren van detecties tegen bedreigingsinformatie en ervoor zorgen dat analisten in de lus blijven voor escalatie en incidentrespons. Ze moeten er ook voor zorgen dat de juiste controles aanwezig zijn om AI -systemen te beschermen tegen tegenstanders, zoals uiteengezet in de SANS Critical AI -beveiligingsrichtlijnen.

Meer informatie bij SANS Cyber Defense Initiative 2025

In december zal SANS LDR514 aanbieden: Strategische planning, beleid en leiderschap van de beveiliging bij SANS Cyber Defense Initiative 2025 in Washington, DC Deze cursus is ontworpen voor leiders die verder willen gaan dan generiek bestuursadvies en leren hoe ze bedrijfsgestuurde beveiligingsprogramma’s kunnen bouwen die organisaties sturen naar de acceptatie van AI. Het zal betrekking hebben op het creëren van bruikbaar beleid, het beheer van bestuur op elkaar afstemming op de bedrijfsstrategie en de beveiliging in cultuur insluiten, zodat u uw onderneming door het AI -tijdperk veilig kunt leiden.

Als u klaar bent om van AI Governance een bedrijf te maken, registreer u dan hier voor SANS CDI 2025.

Opmerking: Dit artikel werd bijgedragen door Frank Kim, Sans Institute Fellow.