De kunstmatige intelligentie Boom verraste de technische industrie. De implementatie van AI resulteerde in tal van positieve resultaten, zoals belangrijke vooruitgang in belangrijke technologieën en de ontwikkeling van indrukwekkende tools die voorheen onmogelijk leken. Het bracht echter ook enkele uitdagingen op die, jaren later, nog steeds worden gezocht om correct te worden aangepakt. SCAM-methoden of misleidingen op basis van AI-aangedreven Deepfakes nemen een bevoorrechte plaats in op de lijst van de meest verontrustende.

Een van de belangrijkste deugden van AI is degene die op zijn beurt ook een van de grootste nadelen heeft gecreëerd. We hebben het over de boost van het tempo van de ontwikkeling in de technische industrie. Hoewel dit positief is voor de industrie op zichzelf, heeft het regelgevers in een binding gebracht. Dezelfde AI -bedrijven zijn ook verstrikt in het probleem, omdat ze niet allemaal hulpmiddelen hebben waarmee ze nauwkeurig kunnen identificeren wanneer een bestand een diepvoeding is en de gebruiker op de hoogte brengt.

Wat is een deepfake?

Misschien ben je nog steeds niet helemaal duidelijk over wat een deepfake is. Kortom, het is inhoud gegenereerd door AI -modellen waarbij het gezicht of lichaam van een persoon digitaal wordt gewijzigd, meestal door het op iemand anders te superponeren. Op deze manier lijkt het slachtoffer betrokken te zijn bij situaties waarin ze nooit waren. Dit is ook van toepassing op audiobestanden waar kwaadaardige acteurs iemands stem ‘klonen’ om hem te laten zeggen wat ze willen.

In de juiste handen zijn dit soort tools behoorlijk handig en stelt u in staat uw creativiteit ten volle te benutten. Naarmate AI Deepfakes echter steeds realistischer zijn geworden, zijn kwaadaardige acteurs ze begonnen met het gebruik van hun oplichting.

Aanvankelijk waren er duidelijke fouten in door AI gegenereerde afbeeldingen, waardoor ze gemakkelijk te identificeren waren met het menselijk oog. Je moest gewoon kijken naar dingen zoals de vingers; Ja, handen trekken is moeilijk, zelfs voor krachtige AI’s. Naarmate generatieve AI -modellen zijn geëvolueerd, is de output echter steeds realistischer geworden. Tegenwoordig zijn veel AI-gegenereerde afbeeldingen niet te onderscheiden van de realiteit. We zouden zelfs kunnen zeggen dat u gemakkelijker door AI gegenereerde illustraties kunt identificeren dan een door AI gegenereerde fotorealistische afbeelding of video.

Deepfake -tools zijn nu beschikbaar voor iedereen, voor beter en voor slechter

Alsof dat niet genoeg was, zijn bedrijven niet tevreden met alleen hulpmiddelen voor beeld-generatie. In de afgelopen jaren hebben we zelfs modellen met videogeratie gezien met indrukwekkende resultaten. Deze maand lanceerde Bytedance-Parent Company of Tiktok-een AI-videogerantiemodel met de meest realistische resultaten die we ooit hebben gezien. Het model, genaamd Omnihuman-1, belooft video dieper tot 10x beter dan voorheen. We hebben het over een ongelooflijke generatiesprong in kwaliteit, en we zullen dit soort dingen elk jaar zien. Hieronder ziet u een klein voorbeeld van waartoe omnihuman-1 in staat is.

China is op 🔥 bytedance -druppels nog een Banger AI -papier!

Omnihuman-1 kan realistische menselijke video’s genereren bij elke beeldverhouding en lichaamsverhoudingen met slechts één afbeelding en audio. Dit is het beste dat ik tot nu toe heb gezien.10 ongelooflijke voorbeelden en de onderzoekspaper link👇 pic.twitter.com/5ojnj0797t

– Ashutoshshrivastava (@AI_FOR_SUCCESS) 4 februari 2025

Verbeterde Deepfakes en AI Tool Democratization hebben ertoe geleid dat meer mensen deze platforms gebruiken. Studenten kunnen ze nuttig vinden voor het verkrijgen van aanvullende afbeeldingen voor projecten of presentaties. Kunstenaars kunnen inspiratie krijgen om aan te werken. Je kunt ook een afbeelding genereren om ook plezier te hebben met vrienden.

Maar wat gebeurt er als kwaadwillende acteurs in het spel komen? Bedrog, manipulatie, afpersing … eigenlijk alle vormen van oplichting die al bestonden, maar veel gemakkelijker gemaakt door AI Deepfakes.

Incidenten gerelateerd aan AI-aangedreven Deepfake-zwendelpogingen

Er zijn talloze gevallen van oplichting geweest in meerdere contexten waar AI Deepfakes de hoofdrolspelers zijn geweest. Resemble.ai heeft een enorme database met incidenten met betrekking tot het gebruik van generatieve AI. Een van de meest recente gevallen zijn de promotie van aandelen of crypto -activa met behulp van het gezicht en de stem van belegger Vijay Kedia. Het is ook heel gebruikelijk om het imago van Elon Musk te gebruiken in video’s waar hij zogenaamd een cryptocurrency promoot. Vrijwel elk gehackt YouTube -kanaal toont dezelfde video met “Elon Musk” die mensen probeert op te lichten door geld of cryptos aan te vragen.

Een ander belangrijk risico met betrekking tot deepfakes zijn de mogelijke gevallen van sextortion. Dit is een praktijk waarbij kwaadaardige derden nep -naakten creëren om te proberen mensen te chanteren door te dreigen hen publiekelijk te verspreiden of naar hun families te sturen. Tieners zijn meestal het belangrijkste doelwit van deze situaties, omdat ze vaker interactie hebben met vreemden op sociale netwerken. Platforms zoals Instagram hebben maatregelen genomen om te proberen dit soort interactie te stoppen. De blootstelling van de tiener begint echter op het moment dat ze besluiten om met een vreemdeling op sociale media te chatten.

Er zijn ook mensen die Deepfakes gebruiken om de publieke opinie te manipuleren. Deze gevallen hebben meestal meerdere oorsprong, hoewel ze vaak voortkomen uit de politieke sfeer. Slechte acteurs kunnen bijvoorbeeld video’s manipuleren om het stemmen voor of tegen een kandidaat bij een verkiezing aan te moedigen. Deze video’s kunnen proberen een bepaalde kandidaat er slecht uit te laten zien of, integendeel, ze er extreem goed uit te laten zien in de ogen van mensen.

Evenzo zijn er gevallen waarin mensen deepfake -afbeeldingen of video’s gebruiken als een hulpmiddel om haat te verspreiden. Er zijn gevallen van gemanipuleerde multimedia om te proberen aversie te creëren tegen een bepaalde gemeenschap of groep. Deze video’s kunnen laten zien dat mensen die iets zeggen dat ze nooit hebben gezegd of dingen doen die ze nooit hebben gedaan.

Imitatie is een andere mogelijkheid in het AI -tijdperk dankzij de kracht van deepfake. Op lijken. AIM bevat een zaak vanaf half februari waar oplichters zich voordoen als legitieme claimhouders. AI -tools stelden hen in staat om realistische video’s te maken die zich voordoen, waardoor ze ongeveer $ 5,6 miljoen aan activa kunnen stelen. In dit geval hadden de oplichters ook enkele persoonlijke gegevens van de slachtoffers, waarschijnlijk verkregen via sociale engineering. Daarom combineert dit scenario het risico van deepfakes met de noodzaak om al uw persoonlijke informatie te beschermen.

Mensen zijn in toenemende mate op zoek naar manieren om deepfakes te detecteren

Er zijn talloze gevallen van diepvallen die worden gebruikt om te proberen te bedriegen, zwendel of bedreigen. Dus mensen moeten steeds voorzichtiger zijn met de multimedia -inhoud die ze op internet zien. In feite wordt de stijgende bezorgdheid al weerspiegeld in de statistieken. Online zoekopdrachten gerelateerd aan “Deepfake -afbeeldingen”Wereldwijd verhoogd met 15% in 2024. De pieken vonden plaats vlak nadat nieuws over hoaxes of oplichting met behulp van AI-aangedreven video’s of afbeeldingen naar voren kwamen. Enkele van de meest populaire gerelateerde zoektermen waren “”Hoe deepfake -afbeeldingen te detecteren” En “Echte versus AI-gegenereerde afbeeldingen. ” Dus de groeiende bezorgdheid onder mensen is echt.

Pogingen tot hoaxes of oplichting op basis van AI Deepfakes zullen waarschijnlijk vanaf nu alleen maar toenemen. Tegenwoordig hebben zelfs smartphones apps waarmee dit type inhoud kan worden gegenereerd. Bovendien is de smartphone zelf een apparaat dat de verspreiding van gemanipuleerde video’s of afbeeldingen vergemakkelijkt. Dit maakt het een tweesnijdend zwaard in het tijdperk van kunstmatige intelligentie.

Zelfs je zou kunnen fungeren als een “slechte acteur” – zonder echt één – vrij genoeg. Het is niet nodig dat u degene bent om een bepaald Deepfake -bestand te maken. Het enige wat u hoeft te doen is een gemanipuleerde afbeelding, video of audio ontvangen en deze delen met uw contacten of op uw sociale netwerken alsof het echt is. Dit is vaak niet 100% jouw schuld, omdat, zoals we eerder zeiden, deepfake -inhoud extreem realistisch kan zijn.

Om gevallen te vermijden waarin u als een “Deepfake-verspreiding” fungeert zonder het te weten of te vallen voor potentiële oplichting die door slechte actoren wordt gepromoot-die zelfs uw veiligheid in gevaar kunnen brengen-moeten AI-gerichte bedrijven handelen. Ze bieden tenslotte de tools om dit soort inhoud te maken. Dus hebben ze ook de intrinsieke verantwoordelijkheid om manieren te vergemakkelijken om het te detecteren.

“Inhoudsreferenties” en “Synthid” proberen de transparantie te stimuleren in het tijdperk van generatieve AI

De technische industrie is niet statisch gebleven tegenover deze situatie. De groeiende ongewenste incidenten gerelateerd aan deepfakes leidden tot de geboorte van de coalitie voor inhoudspansen en authenticiteit (C2PA). Uit deze commissie in kwestie werd ‘content -inloggegevens’ geboren, een standaard die transparantie zoekt in het tijdperk van generatieve AI. “Inhoudsreferenties” integreert en identificeert in feite specifieke metadata in AI-gemanipuleerde afbeeldingen om ze als zodanig te identificeren.

Hoewel dit eenvoudig en snel te implementeren klinkt, is het tot nu toe niet geweest. Dat komt omdat zowel apparaatfabrikanten als AI -ontwikkelaars de standaard moeten aannemen. Dat maakt het proces langzaam, vooral in vergelijking met het tempo van de evolutie van kunstmatige intelligentiemogelijkheden. Vorig jaar lanceerde Sony de vlaggenschipcamera van Alpha 1 II met ondersteuning voor inhoudsreferenties. De nieuwste Samsung Galaxy S25 -serie is ook compatibel met de standaard.

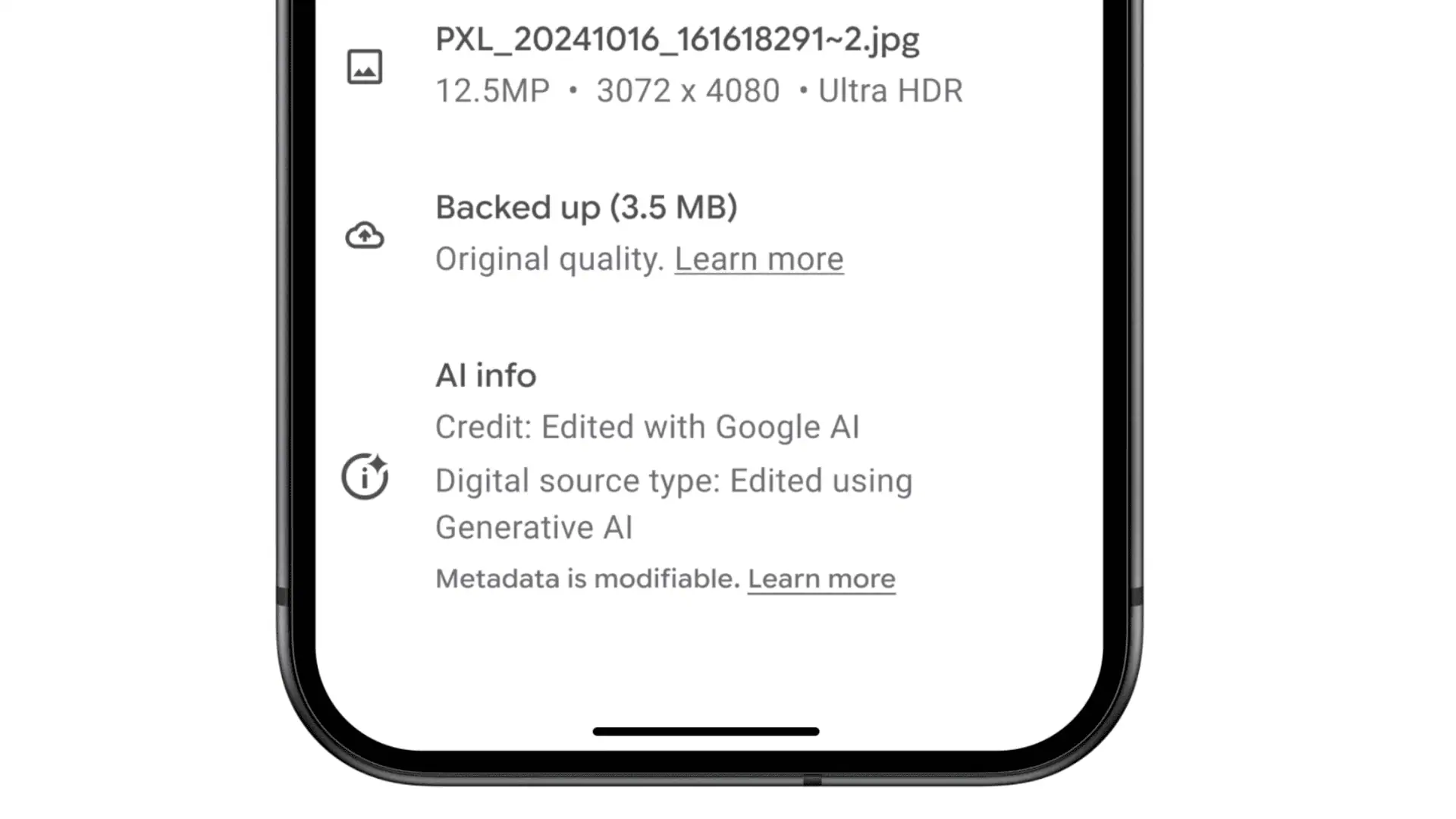

Medio september 2024 kondigde Google zijn toegang tot het C2PA-comité aan. De Mountain View Giant zal zijn middelen en ervaring bijdragen om te proberen het scala aan tools uit te breiden die de transparantie in het AI -tijdperk vergemakkelijken. Google heeft “Synthid” als eigen systeem om bewerkte inhoud te identificeren met behulp van AI-aangedreven tools. In feite heeft het bedrijf deze maand aangekondigd dat foto’s gegenereerd via ‘Reimagine’, de functie in de Magic Editor Suite van Google Photos, een synthid AI -watermerk zullen hebben. De “AI Watermark” is beschikbaar in het gedeelte “AI Info” in de foto-/videogegevens.

Dat gezegd hebbende, Synthid is een minder capabele standaard dan inhoudsreferenties. Momenteel heeft Samsung in de smartphone -industrie het voortouw genomen in transparantie met betrekking tot deepfakes door inhoudsreferenties native te integreren. Geen enkel ander telefoonmerk heeft dit tot nu toe gedaan, dus het is een grote stap. Het valt nog te bezien of contentreferenties via software -updates naar oudere Galaxy -apparaten komen.

Tips om te voorkomen dat ze vallen voor een AI Deepfake -zwendel

Hoewel veel deepfakes misschien niet te onderscheiden zijn van de realiteit, zijn er enkele stappen die je zelf kunt nemen om te voorkomen dat ze het slachtoffer van hen worden. De eerste is om sceptisch te blijven over media -inhoud met publieke cijfers. Als een acteur een nepcryptocurrency promoot of een politicus zich in een surrealistische situatie bevindt, zou uw eerste reactie moeten zijn om aan de authenticiteit van het dossier te twijfelen.

Als de inhoud naar verluidt uit een bepaald publieke figuur komt, controleer dan hun sociale media -handgrepen. Vaak komen video’s van publieke figuren uit hun eigen sociale media -accounts. Als u de inhoud op hun sociale media -accounts niet kunt vinden, blijf dan alert. U moet ook AI -contentidentificatiefuncties op uw apparaat en apps inschakelen. Er zijn gevallen waarin deze tools standaard zijn ingeschakeld, maar ook andere waar ze dat niet zijn.

Ten slotte zijn er ook deepfake -detectietools waar u zich kunt wenden. Hoewel ze af en toe falen, zijn ze meestal behoorlijk effectief. Er zijn meerdere vergelijkbare platforms beschikbaar, zowel publiekelijk als exclusief voor een bepaald systeem of hardware. Deepware -scanner is er een die u vrijelijk zelf kunt gebruiken vanuit een browser. Anderen, zoals DuckduckGoose, Intel Fakecatcher en reality -verdediger, zijn ontworpen met bedrijven in gedachten.

Kortom, AI-aangedreven Deepfakes zijn hier om te blijven, maar dat is niet noodzakelijk een slechte zaak. De indrukwekkende mogelijkheden van kunstmatige intelligentie zijn ook erg nuttig voor het stimuleren van de productiviteit, het zoeken naar extra inspiratie, het optimaliseren van de workflow, het besparen van tijd en het ontketenen van uw creativiteit. U moet zich echter bewust zijn van de context waarin we ons bevinden en waakzamer zijn over hoe u omgaat met de inhoud die u op internet consumeert.

Hopelijk zullen AI -ontwikkelaars en ontwikkelaars van AI -tools normen zoals inhoudsreferenties gebruiken. Dit zou een grote hulp zijn voor het grote publiek, vooral de minder technisch onderlegde.