Google zei donderdag dat het de aan Noord-Korea gelinkte dreigingsacteur heeft waargenomen, bekend als UNC2970 het gebruik van zijn generatieve kunstmatige intelligentie (AI)-model Gemini om verkenningen uit te voeren op zijn doelen, terwijl verschillende hackgroepen de tool blijven inzetten voor het versnellen van verschillende fasen van de levenscyclus van cyberaanvallen, het mogelijk maken van informatieoperaties en zelfs het uitvoeren van modelextractieaanvallen.

“De groep gebruikte Gemini om OSINT te synthetiseren en waardevolle doelen te profileren ter ondersteuning van campagneplanning en verkenning”, aldus Google Threat Intelligence Group (GTIG) in een rapport gedeeld met The Hacker News. “De beoogde profilering van deze actor omvatte het zoeken naar informatie over grote cyberbeveiligings- en defensiebedrijven en het in kaart brengen van specifieke technische functies en salarisinformatie.”

Het dreigingsinformatieteam van de technologiegigant typeerde deze activiteit als een vervaging van de grenzen tussen wat routinematig professioneel onderzoek en kwaadwillige verkenning inhoudt, waardoor de door de staat gesteunde actor op maat gemaakte phishing-persona’s kon creëren en zachte doelwitten kon identificeren voor een eerste compromis.

UNC2970 is de bijnaam die is toegewezen aan een Noord-Koreaanse hackgroep die overlapt met een cluster dat wordt gevolgd als Lazarus Group, Diamond Sleet en Hidden Cobra. Het is vooral bekend vanwege het orkestreren van een langlopende campagne met de codenaam Operation Dream Job om de lucht- en ruimtevaart-, defensie- en energiesector met malware te targeten onder het mom van het benaderen van slachtoffers onder het voorwendsel van vacatures.

GTIG zei dat UNC2970 zich in hun campagnes ‘consequent’ heeft gefocust op het targeten van defensie en het nabootsen van bedrijfsrecruiters, waarbij de targetprofilering onder meer zoekopdrachten omvat naar ‘informatie over grote cyberbeveiligings- en defensiebedrijven en het in kaart brengen van specifieke technische functies en salarisinformatie.’

UNC2970 is verre van de enige dreigingsactoren die Gemini heeft misbruikt om hun capaciteiten uit te breiden en sneller over te gaan van initiële verkenning naar actieve targeting. Enkele van de andere hackploegen die de tool in hun workflows hebben geïntegreerd, zijn als volgt:

- UNC6418 (Niet toegeschreven), om gerichte inlichtingen te verzamelen, met name op zoek naar gevoelige accountgegevens en e-mailadressen.

- Temp.HEX of Mustang Panda (China), om een dossier op te stellen over specifieke individuen, inclusief doelwitten in Pakistan, en om operationele en structurele gegevens te verzamelen over separatistische organisaties in verschillende landen.

- APT31 of Oordeel Panda (China), om de analyse van kwetsbaarheden te automatiseren en gerichte testplannen te genereren door zich voor te doen als beveiligingsonderzoeker.

- APT41 (China), om uitleg te extraheren uit README.md-pagina’s van de open-sourcetool, en om exploitcode op te lossen en te debuggen.

- UNC795 (China), om problemen met hun code op te lossen, onderzoek te doen en webshells en scanners voor PHP-webservers te ontwikkelen.

- APT42 (Iran), om verkenning en gerichte social engineering te vergemakkelijken door persona’s te creëren die betrokkenheid van de doelwitten opwekken, evenals een op Python gebaseerde Google Maps-scraper te ontwikkelen, een simkaartbeheersysteem in Rust te ontwikkelen en het gebruik van een proof-of-concept (PoC) voor een WinRAR-fout te onderzoeken (CVE-2025-8088).

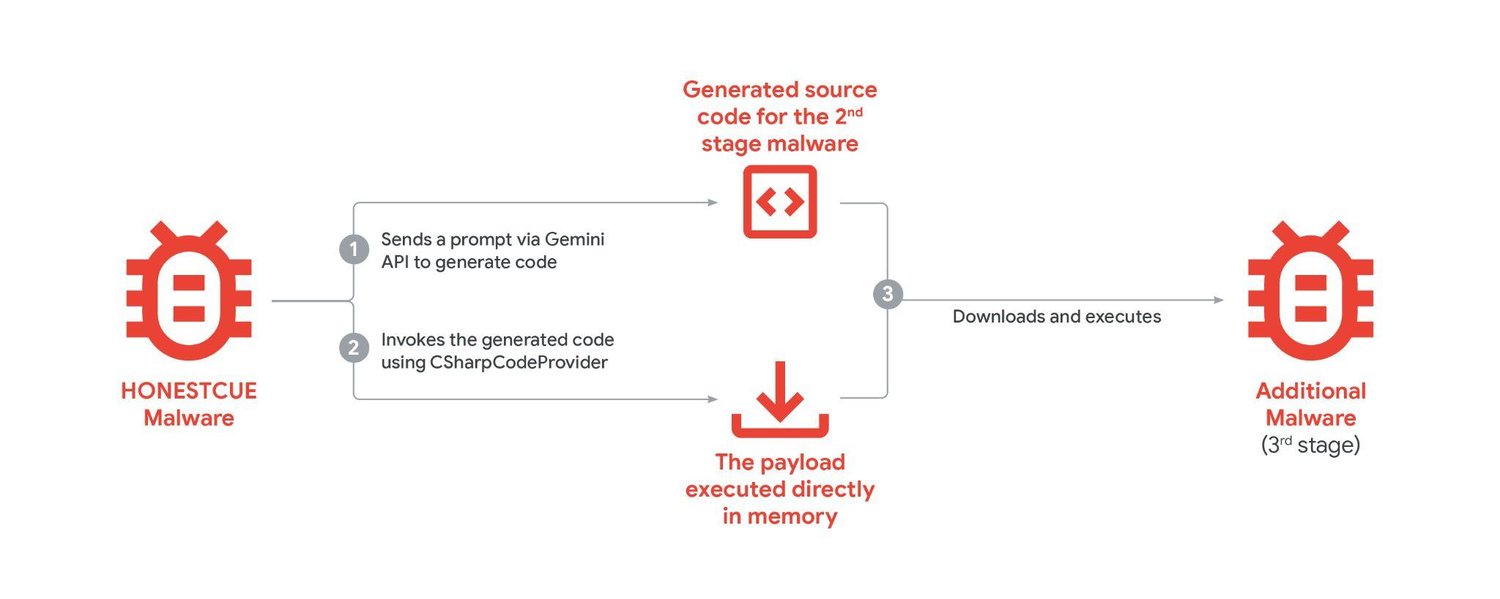

Google zei ook dat het een malware heeft gedetecteerd genaamd HONESTCUE die gebruik maakt van de Gemini-API om het genereren van functionaliteit voor de volgende fase uit te besteden, samen met een door AI gegenereerde phishing-kit met de codenaam COINBAIT die is gebouwd met behulp van Lovable AI en die zich voordoet als een cryptocurrency-uitwisseling voor het verzamelen van inloggegevens. Sommige aspecten van COINBAIT-gerelateerde activiteiten zijn toegeschreven aan een financieel gemotiveerde dreigingscluster genaamd UNC5356.

“HONESTCUE is een downloader- en launcher-framework dat een prompt verzendt via de API van Google Gemini en als reactie C#-broncode ontvangt”, aldus het rapport. “In plaats van een LLM te gebruiken om zichzelf te updaten, roept HONESTCUE echter de Gemini API aan om code te genereren die de ‘fase twee’-functionaliteit beheert, die een ander stuk malware downloadt en uitvoert.”

De bestandsloze secundaire fase van HONESTCUE neemt vervolgens de gegenereerde C#-broncode die is ontvangen van de Gemini API en gebruikt het legitieme .NET CSharpCodeProvider-framework om de payload rechtstreeks in het geheugen te compileren en uit te voeren, waardoor er geen artefacten op schijf achterblijven.

Google heeft ook de aandacht gevestigd op een recente golf van ClickFix-campagnes die gebruik maken van de openbare deelfunctie van generatieve AI-services om realistisch ogende instructies te hosten om een veelvoorkomend computerprobleem op te lossen en uiteindelijk informatiestelende malware af te leveren. De activiteit werd in december 2025 gemarkeerd door Huntress.

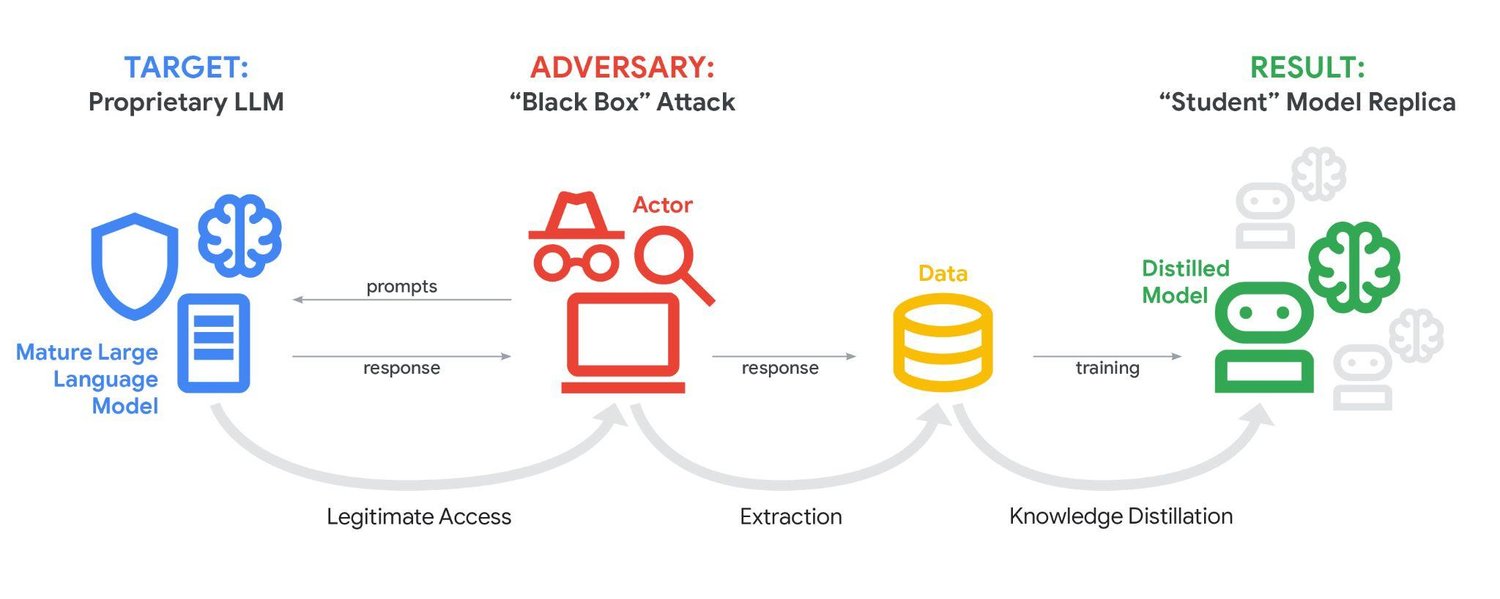

Ten slotte zei het bedrijf dat het modelextractieaanvallen heeft geïdentificeerd en verstoord die gericht zijn op het systematisch bevragen van een eigen machine learning-model om informatie te extraheren en een vervangend model te bouwen dat het gedrag van het doelwit weerspiegelt. Bij een grootschalige aanval van deze soort werd Gemini het doelwit van meer dan 100.000 prompts die een reeks vragen stelden die erop gericht waren het redeneervermogen van het model te repliceren voor een breed scala aan taken in niet-Engelse talen.

Vorige maand bedacht Praetorian een PoC-extractieaanval waarbij een replicamodel een nauwkeurigheidspercentage van 80,1% behaalde door simpelweg een reeks van 1.000 vragen naar de API van het slachtoffer te sturen en de resultaten vast te leggen en deze gedurende 20 tijdperken te trainen.

“Veel organisaties gaan ervan uit dat het privé houden van modelgewichten voldoende bescherming biedt”, zegt beveiligingsonderzoeker Farida Shafik. “Maar dit creëert een vals gevoel van veiligheid. In werkelijkheid is gedrag het model. Elk vraag-antwoordpaar is een trainingsvoorbeeld voor een replica. Het gedrag van het model wordt via elk API-antwoord blootgelegd.”