Google zei woensdag dat het een onbekende bedreigingsacteur heeft ontdekt die gebruik maakt van een experimentele Visual Basic Script (VB Script) malware genaamd PROMPTFLUX die samenwerkt met de Gemini-API voor kunstmatige intelligentie (AI) om zijn eigen broncode te schrijven voor verbeterde verduistering en ontduiking.

“PROMPTFLUX is geschreven in VBScript en werkt samen met de Gemini-API om specifieke VBScript-verduisterings- en ontduikingstechnieken aan te vragen om ‘just-in-time’ zelfaanpassing mogelijk te maken, waardoor waarschijnlijk statische handtekeninggebaseerde detectie wordt omzeild”, aldus Google Threat Intelligence Group (GTIG) in een rapport gedeeld met The Hacker News.

De nieuwe functie maakt deel uit van de “Thinking Robot” -component, die periodiek het grote taalmodel (LLM), Gemini 1.5 Flash of hoger in dit geval, bevraagt om nieuwe code te verkrijgen om detectie te omzeilen. Dit wordt op zijn beurt bereikt door een hardgecodeerde API-sleutel te gebruiken om de query naar het Gemini API-eindpunt te sturen.

De prompt die naar het model wordt gestuurd, is zowel zeer specifiek als machinaal parseerbaar, waarbij wordt gevraagd om wijzigingen in de VB-scriptcode om antivirusprogramma’s te ontwijken en het model wordt geïnstrueerd om alleen de code zelf uit te voeren.

Afgezien van de regeneratiemogelijkheid slaat de malware de nieuwe, versluierde versie op in de opstartmap van Windows om persistentie tot stand te brengen en probeert hij zich te verspreiden door zichzelf te kopiëren naar verwisselbare schijven en toegewezen netwerkshares.

“Hoewel de zelfmodificatiefunctie (AttemptToUpdateSelf) wordt becommentarieerd, geeft de aanwezigheid ervan, gecombineerd met de actieve registratie van AI-reacties op ‘%TEMP%thinking_robot_log.txt’, duidelijk het doel van de auteur aan om een metamorf script te creëren dat in de loop van de tijd kan evolueren”, voegde Google eraan toe.

De technologiegigant zei ook dat het meerdere varianten van PROMPTFLUX heeft ontdekt die LLM-gestuurde coderegeneratie bevatten, waarbij één versie een prompt gebruikt om de volledige broncode van de malware elk uur te herschrijven door de LLM te instrueren om op te treden als een ‘expert VB Script-obfuscator’.

Er wordt aangenomen dat PROMPTFLUX zich in de ontwikkelings- of testfase bevindt, waarbij de malware momenteel geen middelen heeft om een slachtoffernetwerk of apparaat in gevaar te brengen. Het is momenteel niet bekend wie er achter de malware zit, maar er zijn tekenen die wijzen op een financieel gemotiveerde bedreigingsacteur die een brede, geografische en sectoronafhankelijke aanpak hanteert om zich op een breed scala aan gebruikers te richten.

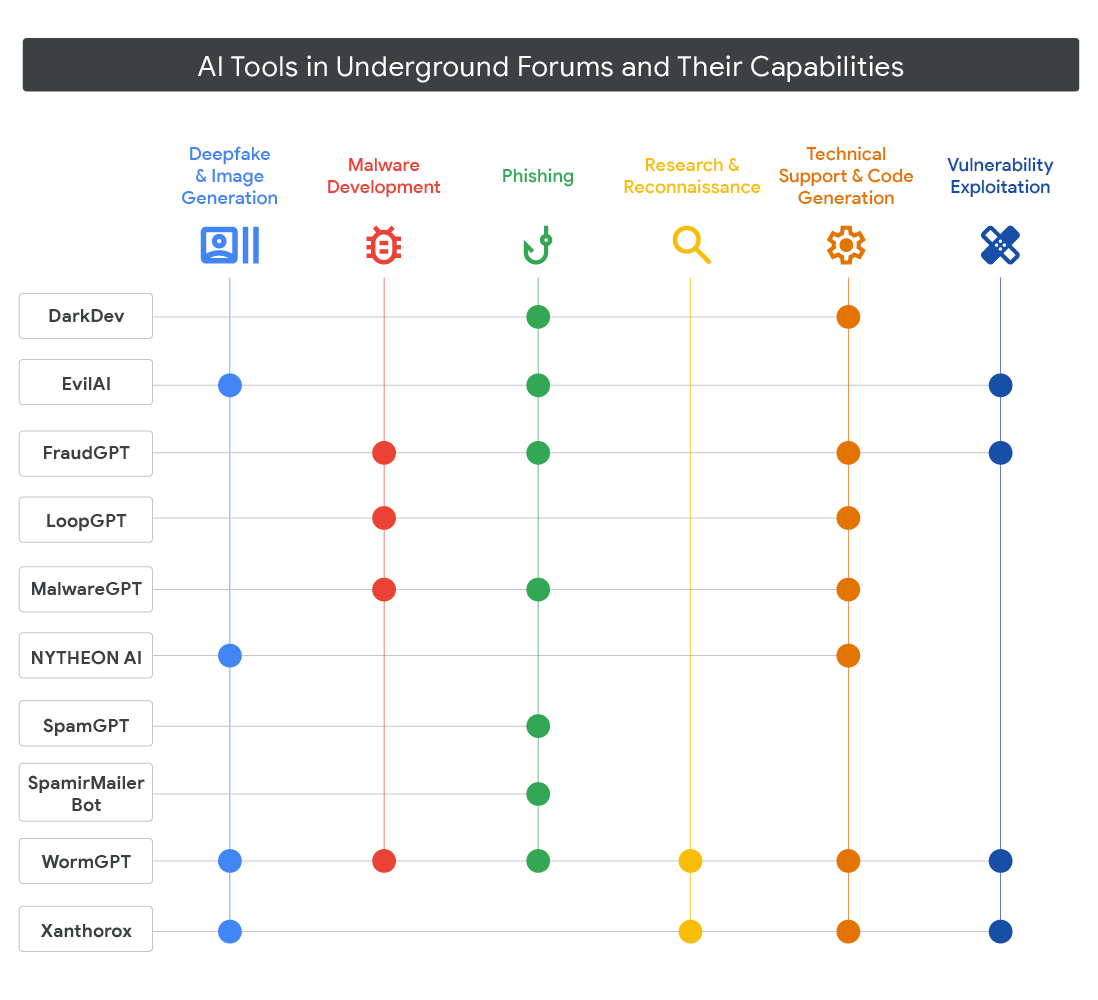

Google merkte ook op dat tegenstanders verder gaan dan het gebruik van AI voor eenvoudige productiviteitswinst, maar tools creëren die in staat zijn hun gedrag tijdens de uitvoering aan te passen, om nog maar te zwijgen van het ontwikkelen van speciaal gebouwde tools die vervolgens op ondergrondse forums worden verkocht voor financieel gewin. Enkele van de andere gevallen van door LLM aangedreven malware die door het bedrijf zijn waargenomen, zijn de volgende:

- FRUITSCHELeen omgekeerde shell geschreven in PowerShell die hardgecodeerde aanwijzingen bevat om detectie of analyse door LLM-aangedreven beveiligingssystemen te omzeilen

- PROMPTLOCKeen platformonafhankelijke ransomware geschreven in Go die een LLM gebruikt om kwaadwillige Lua-scripts tijdens runtime dynamisch te genereren en uit te voeren (geïdentificeerd als een proof-of-concept)

- SNELSTEAL (ook bekend als LAMEHUG), een dataminer die door de Russische staatsgesteunde actor APT28 wordt gebruikt bij aanvallen gericht op Oekraïne, die Qwen2.5-Coder-32B-Instruct vraagt om opdrachten te genereren voor uitvoering via de API voor Hugging Face

- STILVAULTeen credential stealer geschreven in JavaScript die zich richt op GitHub- en NPM-tokens

Vanuit Gemini-oogpunt zei het bedrijf dat het een Chinese nexus-bedreigingsacteur had waargenomen die zijn AI-tool misbruikte om overtuigende kunstaasinhoud te maken, technische infrastructuur op te bouwen en tools voor data-exfiltratie te ontwerpen.

In ten minste één geval zou de bedreigingsacteur zijn aanwijzingen hebben geherformuleerd door zichzelf te identificeren als deelnemer aan een capture-the-flag (CTF)-oefening om vangrails te omzeilen en het AI-systeem te misleiden om nuttige informatie terug te sturen die kan worden gebruikt om een gecompromitteerd eindpunt te exploiteren.

“De acteur leek van deze interactie te leren en gebruikte het CTF-voorwendsel ter ondersteuning van phishing, exploitatie en webshell-ontwikkeling”, aldus Google. “De acteur liet veel van zijn vragen over de exploitatie van specifieke software en e-maildiensten voorafgaan door opmerkingen als ‘Ik werk aan een CTF-probleem’ of ‘Ik zit momenteel in een CTF en ik zag iemand van een ander team zeggen…’ Deze aanpak gaf advies over de volgende exploitatiestappen in een ‘CTF-scenario.'”

Andere voorbeelden van Gemini-misbruik door door de staat gesponsorde actoren uit China, Iran en Noord-Korea om hun operaties te stroomlijnen, waaronder verkenning, het creëren van phishing-lokmiddelen, de ontwikkeling van command-and-control (C2) en data-exfiltratie, worden hieronder vermeld:

- Het misbruik van Gemini door een vermoedelijke Chinese nexus-acteur bij verschillende taken, variërend van het uitvoeren van initiële verkenningen van interessante doelwitten en phishing-technieken tot het leveren van ladingen en het zoeken naar hulp bij laterale verplaatsing en methoden voor gegevensexfiltratie

- Het misbruik van Gemini door de Iraanse natiestaatacteur APT41 voor hulp bij codeverduistering en het ontwikkelen van C++- en Golang-code voor meerdere tools, waaronder een C2-framework genaamd OSSTUN

- Het misbruik van Gemini door de Iraanse natiestaatacteur Modderig Water (ook bekend als Mango Sandstorm, MUDDYCOAST of TEMP.Zagros) om onderzoek te doen ter ondersteuning van de ontwikkeling van aangepaste malware ter ondersteuning van bestandsoverdracht en uitvoering op afstand, terwijl veiligheidsbarrières worden omzeild door te beweren een student te zijn die aan een afstudeerproject aan de universiteit werkt of een artikel over cyberbeveiliging schrijft

- Het misbruik van Gemini door de Iraanse natiestaatacteur APT42 (ook bekend als Charming Kitten en Mint Sandstorm) om materiaal te maken voor phishing-campagnes waarbij vaak personen uit denktanks worden nagebootst, artikelen en berichten worden vertaald, onderzoek wordt gedaan naar de Israëlische defensie en een ‘Data Processing Agent’ wordt ontwikkeld die verzoeken in natuurlijke taal omzet in SQL-query’s om inzichten uit gevoelige gegevens te verkrijgen

- Het misbruik van Gemini door de Noord-Koreaanse dreigingsacteur UNC1069 (ook bekend als CryptoCore of MASAN) – een van de twee clusters naast TraderTraitor (ook bekend als PUKCHONG of UNC4899) die de inmiddels ter ziele gegane APT38 (ook bekend als BlueNoroff) heeft opgevolgd – om lokmateriaal voor social engineering te genereren, code te ontwikkelen om cryptocurrency te stelen en frauduleuze instructies te maken die een software-update nabootsen om gebruikersgegevens te extraheren

- Het misbruik van Gemini door HandelaarVerrader om code te ontwikkelen, exploits te onderzoeken en hun tools te verbeteren

Bovendien zei GTIG onlangs te hebben waargenomen dat UNC1069 deepfake-afbeeldingen en video-lokmiddelen gebruikt die zich voordoen als individuen in de cryptocurrency-industrie in hun social engineering-campagnes om een achterdeur genaamd BIGMACHO te distribueren naar slachtoffersystemen onder het mom van een Zoom-softwareontwikkelingskit (SDK). Het is vermeldenswaard dat een bepaald aspect van de activiteit overeenkomsten vertoont met de GhostCall-campagne die onlangs door Kaspersky werd onthuld.

De ontwikkeling komt op het moment dat Google zei dat het van bedreigingsactoren verwacht dat ze “resoluut overgaan van het gebruik van AI als uitzondering naar het gebruik ervan als de norm” om de snelheid, reikwijdte en effectiviteit van hun operaties te vergroten, waardoor ze aanvallen op schaal kunnen uitvoeren.

“De toenemende toegankelijkheid van krachtige AI-modellen en het groeiende aantal bedrijven dat deze in de dagelijkse bedrijfsvoering integreert, creëren perfecte omstandigheden voor snelle injectie-aanvallen”, aldus het rapport. “Bedreigingsactoren verfijnen hun technieken snel, en de lage kosten en hoge opbrengsten van deze aanvallen maken ze tot een aantrekkelijke optie.”