Cybersecurity-onderzoekers hebben details onthuld van een inmiddels gepatchte kwetsbaarheid in de populaire figma-developer-mcp Model Context Protocol (MCP)-server waarmee aanvallers code kunnen uitvoeren.

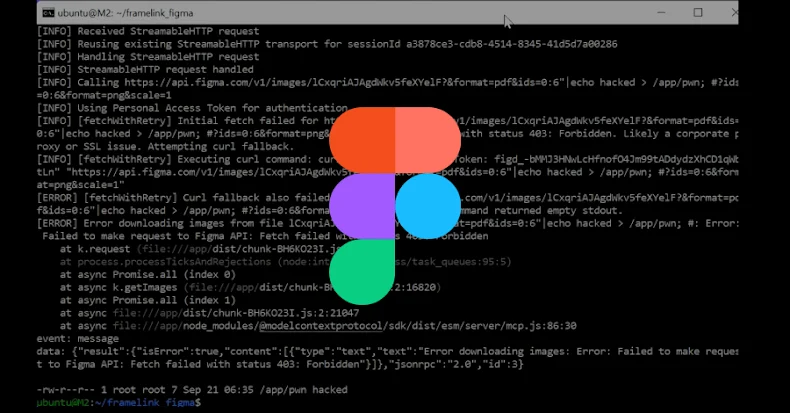

De kwetsbaarheid, bijgehouden als CVE-2025-53967 (CVSS-score: 7,5), is een bug voor het injecteren van commando’s die voortkomt uit het onopgeschoonde gebruik van gebruikersinvoer, waardoor de deur wordt geopend naar een scenario waarin een aanvaller willekeurige systeemcommando’s kan verzenden.

“De server construeert en voert shell-opdrachten uit met behulp van niet-gevalideerde gebruikersinvoer rechtstreeks binnen opdrachtregelreeksen. Dit introduceert de mogelijkheid van injectie van shell-metakarakters (|, >, &&, etc.)”, aldus een GitHub-advies voor de fout. “Succesvolle exploitatie kan leiden tot uitvoering van code op afstand onder de privileges van het serverproces.”

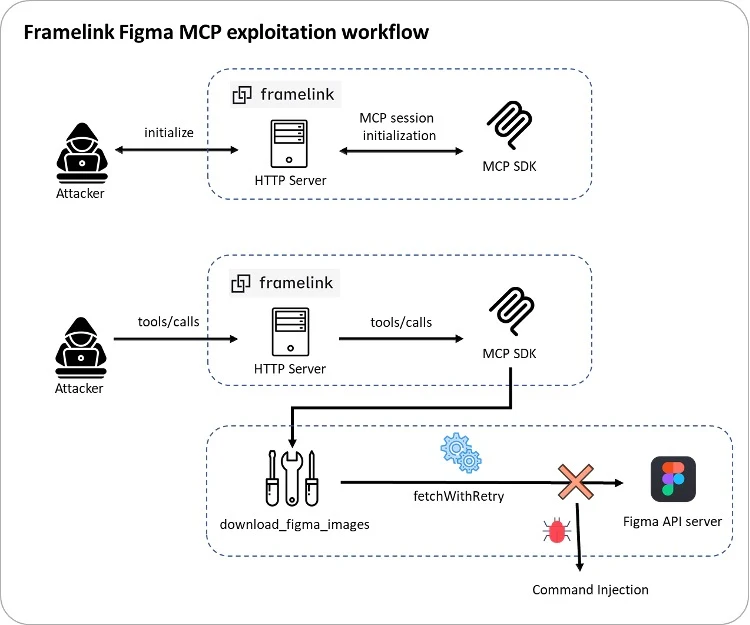

Aangezien de Framelink Figma MCP-server verschillende tools beschikbaar stelt om bewerkingen in Figma uit te voeren met behulp van door kunstmatige intelligentie (AI) aangedreven codeermiddelen zoals Cursor, zou een aanvaller de MCP-client kunnen misleiden om onbedoelde acties uit te voeren door middel van een indirecte promptinjectie.

Cyberbeveiligingsbedrijf Imperva, dat het probleem in juli 2025 ontdekte en rapporteerde, beschreef CVE-2025-53967 als een “ontwerptoezicht” in het fallback-mechanisme waarmee kwaadwillenden volledige code-uitvoering op afstand konden uitvoeren, waardoor ontwikkelaars het risico liepen dat gegevens werden blootgesteld.

De fout in de opdrachtinjectie “doet zich voor tijdens de constructie van een opdrachtregelinstructie die wordt gebruikt om verkeer naar het Figma API-eindpunt te sturen”, aldus beveiligingsonderzoeker Yohann Sillam.

De exploitatievolgorde vindt plaats via stappen –

- De MCP-client verzendt een initialisatieverzoek naar het MCP-eindpunt om een mcp-session-id te ontvangen die wordt gebruikt bij daaropvolgende communicatie met de MCP-server

- De client stuurt een JSONRPC-verzoek naar de MCP-server met de methode tools/call om tools zoals get_figma_data of download_figma_images aan te roepen

Het probleem zit in de kern in “src/utils/fetch-with-retry.ts”, dat eerst probeert inhoud op te halen met behulp van de standaard fetch-API en, als dat niet lukt, doorgaat met het uitvoeren van de curl-opdracht via child_process.exec – wat de fout in de opdrachtinjectie introduceert.

“Omdat het curl-commando wordt geconstrueerd door URL- en headerwaarden rechtstreeks te interpoleren in een shell-opdrachtstring, kan een kwaadwillende actor een speciaal ontworpen URL- of headerwaarde maken die willekeurige shell-commando’s injecteert”, aldus Imperva. “Dit kan leiden tot uitvoering van externe code (RCE) op de hostmachine.”

Bij een proof-of-concept-aanval kan een kwaadwillende op afstand op hetzelfde netwerk (bijvoorbeeld een openbaar Wi-Fi-netwerk of een gecompromitteerd bedrijfsapparaat) de fout activeren door een reeks verzoeken naar de kwetsbare MCP te sturen. Als alternatief kan de aanvaller een slachtoffer ertoe verleiden een speciaal vervaardigde site te bezoeken als onderdeel van een DNS-rebinding-aanval.

Het beveiligingslek is verholpen in versie 0.6.3 van figma-developer-mcp, uitgebracht op 29 september 2025. Als oplossing is het raadzaam om het gebruik van child_process.exec met niet-vertrouwde invoer te vermijden en over te schakelen naar child_process.execFile, waardoor het risico op shell-interpretatie wordt geëlimineerd.

“Terwijl AI-gestuurde ontwikkelingstools blijven evolueren en steeds vaker worden geaccepteerd, is het van essentieel belang dat veiligheidsoverwegingen gelijke tred houden met innovatie”, aldus het bedrijf dat eigendom is van Thales. “Deze kwetsbaarheid herinnert ons er duidelijk aan dat zelfs tools die bedoeld zijn om lokaal te draaien, krachtige toegangspunten voor aanvallers kunnen worden.”

De ontwikkeling komt op het moment dat FireTail onthulde dat Google ervoor heeft gekozen om geen nieuwe ASCII-smokkelaanval in zijn Gemini AI-chatbot op te lossen, die zou kunnen worden bewapend om invoer te maken die door beveiligingsfilters kan glippen en ongewenste reacties kan veroorzaken. Andere grote taalmodellen (LLM’s) die vatbaar zijn voor deze aanval zijn DeepSeek en xAI’s Grok.

“En deze fout is vooral gevaarlijk wanneer LLM’s, zoals Gemini, diep geïntegreerd zijn in bedrijfsplatforms zoals Google Workspace”, aldus het bedrijf. “Deze techniek maakt geautomatiseerde identiteitsspoofing en systematische gegevensvergiftiging mogelijk, waardoor een UI-fout verandert in een potentiële beveiligingsnachtmerrie.”