Een beveiligingszwakte is bekendgemaakt in de cursor met kunstmatige intelligentie (AI) -code-editor die de uitvoering van code kan activeren wanneer een kwaadaardig vervaardigde repository wordt geopend met behulp van het programma.

Het probleem komt voort uit het feit dat een out-of-the-box beveiligingsinstelling standaard is uitgeschakeld, waardoor de deur wordt geopend voor aanvallers om willekeurige code op de computers van gebruikers met hun privileges uit te voeren.

“Cursor wordt standaard verzonden met Workspace Trust uitgeschakeld, dus versus code-stijl taken geconfigureerd met runOptions.Runon: ‘MaperOpen’ automatisch uitvoeren op het moment dat een ontwikkelaar een project bladert,” zei Oasis Security in een analyse. “Een kwaadaardige .vscode/tasks.json verandert een casual ‘open map’ in stille code -uitvoering in de context van de gebruiker.”

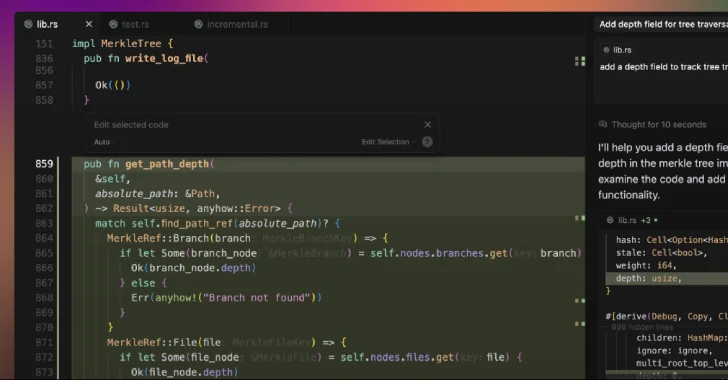

Cursor is een AI-aangedreven vork van Visual Studio Code, die een functie ondersteunt genaamd Workspace Trust om ontwikkelaars in staat te stellen veilig te bladeren en code te bewerken, ongeacht waar het vandaan kwam of die het schreef.

Met deze optie uitgeschakeld, kan een aanvaller een project beschikbaar stellen in GitHub (of elk platform) en een verborgen “autorun” -instructie opnemen die de IDE instrueert om een taak uit te voeren zodra een map wordt geopend, waardoor schadelijke code wordt uitgevoerd wanneer het slachtoffer probeert te bladeren door de booby-ingedopte repository in cursor.

“Dit heeft het potentieel om gevoelige referenties te lekken, bestanden te wijzigen of te dienen als een vector voor breder systeemcompromis, waarbij cursormebruikers een aanzienlijk risico lopen op aanvallen van supply chain,” zei Oasis Security Researcher Erez Schwartz.

Om deze dreiging tegen te gaan, wordt gebruikers geadviseerd om vertrouwen op de werkplek in cursor mogelijk te maken, niet -vertrouwde repositories in een andere code -editor te openen en ze te controleren voordat ze in de tool worden geopend.

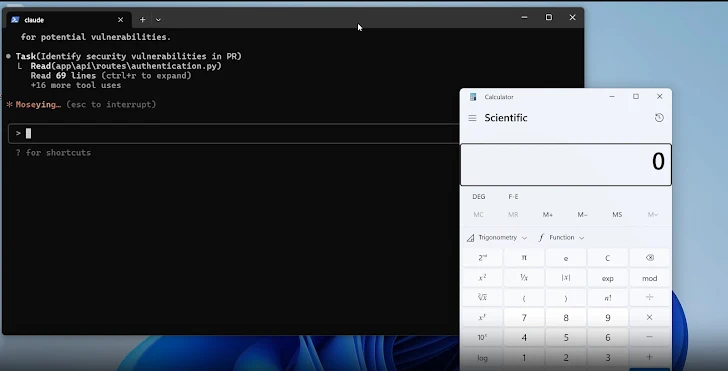

De ontwikkeling komt omdat snelle injecties en jailbreaks naar voren zijn gekomen als een heimelijke en systemische dreiging die AI-aangedreven codering- en redeneringsagenten zoals Claude-code, Cline, K2 Denk en Windsurf en Windsurf te plaagt, waardoor bedreigingsactoren kwaadaardige instructies kunnen insluiten op stiekeme manieren in stiekeme manieren in drijfachtige manieren in te doelen om de systemen uit te voeren om de systemen uit te voeren om de systemen uit te voeren om de systemen uit te voeren in het uitvoeren van kwaadaardige acties uit softwareontwikkelingsomgevingen.

Software Supply Chain Security Outfit CheckMarx, in een rapport vorige week, onthulde hoe de nieuw geïntroduceerde geautomatiseerde beveiligingsreviews van Anthropic in Claude -code per ongeluk projecten kunnen blootstellen aan beveiligingsrisico’s, inclusief het instrueren van het instrueren van kwetsbare code door snelle injecties, waardoor ontwikkelaars kwaadaardig of vaste code verleden beveiligingsrecensies duwden.

“In dit geval kan een zorgvuldig geschreven opmerking Claude overtuigen dat zelfs duidelijk gevaarlijke code volkomen veilig is,” zei het bedrijf. “Het eindresultaat: een ontwikkelaar – schadelijk of gewoon probeert Claude te sluiten – kan Claude gemakkelijk misleiden door te denken dat een kwetsbaarheid veilig is.”

Een ander probleem is dat het AI -inspectieproces ook testcases genereert en uitvoert, wat zou kunnen leiden tot een scenario waarbij kwaadaardige code wordt uitgevoerd tegen productiedatabases als Claude -code niet correct sandboxed is.

Het AI -bedrijf, dat onlangs ook een nieuwe functie voor het maken en bewerken van bestanden in Claude heeft gelanceerd, heeft gewaarschuwd dat de functie snelle injectie -risico’s met zich meebrengt omdat het in een “sandboxed computeromgeving met beperkte internettoegang” loopt.

In het bijzonder is het mogelijk voor een slechte acteur om “onopvallend” instructies toe te voegen via externe bestanden of websites – AKA indirecte snelle injectie – die de chatbot misleiden om niet -getruste code te downloaden en te uitvoeren of gevoelige gegevens te lezen uit een kennisbron die is verbonden via het modelcontextprotocol (MCP).

“Dit betekent dat Claude kan worden misleid om informatie uit zijn context te verzenden (bijvoorbeeld prompts, projecten, gegevens via MCP, Google -integraties) naar kwaadaardige derden,” zei Anthropic. “Om deze risico’s te verminderen, raden we u aan Claude te controleren tijdens het gebruik van de functie en te stoppen als u deze onverwachts ziet of toegang krijgt tot gegevens.”

Dat is niet alles. Eind vorige maand onthulde het bedrijf ook browser-gebruikelijke AI-modellen zoals Claude voor Chrome kan worden geconfronteerd met snelle injectieaanvallen, en dat het verschillende verdedigingen heeft geïmplementeerd om de dreiging aan te pakken en het aanvalsucces van 23,6% te verminderen tot 11,2%.

“Nieuwe vormen van snelle injectieaanvallen worden ook voortdurend ontwikkeld door kwaadaardige acteurs,” voegde het eraan toe. “Door real-world voorbeelden te ontdekken van onveilig gedrag en nieuwe aanvalspatronen die niet aanwezig zijn in gecontroleerde tests, zullen we onze modellen leren de aanvallen te herkennen en het gerelateerde gedrag te verklaren, en ervoor te zorgen dat veiligheidsclassificaties alles zullen oppakken wat het model zelf mist.”

Tegelijkertijd zijn deze tools ook vatbaar gevonden voor traditionele beveiligingskwetsbaarheden, waardoor het aanvalsoppervlak wordt verbreed met potentiële impact in de praktijk –

- Een WebSocket-authenticatie-bypass in Claude-code IDE-extensies (CVE-2025-52882, CVSS-score: 8.8) die een aanvaller had kunnen hebben in staat te stellen verbinding te maken met de niet-geauthenticeerde lokale Websocket-server van een slachtoffer door ze te lokken om een website onder hun controle te bezoeken.

- Een SQL-injectie-kwetsbaarheid in de MCP-server Postgres die een aanvaller had kunnen hebben kunnen omzeilen om de alleen-lezen beperking te omzeilen en willekeurige SQL-instructies uit te voeren

- Een kwetsbaarheid voor padverweging in Microsoft NLWeb waardoor een externe aanvaller gevoelige bestanden had kunnen lezen, inclusief systeemconfiguraties (“/etc/passwd”) en cloudreferenties (.env -bestanden), met behulp van een speciaal vervaardigde URL

- Een onjuiste autorisatie-kwetsbaarheid in Lovable (CVE-2025-48757, CVSS-score: 9.3) waardoor externe niet-geautoreerde aanvallers kunnen lezen of schrijven naar willekeurige databasetafels van gegenereerde sites

- Open Redirect, opgeslagen cross-site scripting (XSS) en gevoelige kwetsbaarheden voor gegevenslekkage in Base44 die aanvallers hadden kunnen hebben toegestaan toegang te krijgen tot de apps van het slachtoffer en de ontwikkelingswerkruimte, API-toetsen, injecteren kwaadaardige logica in door gebruikers gegenereerde applicaties en gegevens van het slachtoffer.

- Een kwetsbaarheid in Ollama Desktop die ontstaat als gevolg van onvolledige cross-origin-bedieningselementen waardoor een aanvaller een drive-by-aanval had kunnen organiseren, waar een bezoek aan een kwaadwillende website de instellingen van de applicatie opnieuw kan configureren om chats te onderscheppen en zelfs de reacties te wijzigen met behulp van vergiftigde modellen

“Terwijl AI-gedreven ontwikkeling versnelt, zijn de meest dringende bedreigingen vaak geen exotische AI-aanvallen, maar falen in klassieke veiligheidscontroles,” zei Imperva. “Om het groeiende ecosysteem van ‘sfeercodering’ -platforms te beschermen, moet beveiliging worden behandeld als een basis, niet als een bijzaak.”