Anthropic op woensdag onthulde dat het een verfijnde operatie verstoorde die zijn kunstmatige intelligentie (AI) bewapende Chatbot Claude bewapende om grootschalige diefstal en afpersing van persoonlijke gegevens in juli 2025 uit te voeren.

“De acteur richtte zich op ten minste 17 verschillende organisaties, waaronder in de gezondheidszorg, de hulpdiensten en de overheid, en religieuze instellingen,” zei het bedrijf. “In plaats van de gestolen informatie te coderen met traditionele ransomware, dreigde de acteur de gegevens publiekelijk bloot te leggen om slachtoffers te proberen af te persen om losgeld te betalen die soms $ 500.000 overschreden.”

“De acteur gebruikte Claude -code op Kali Linux als een uitgebreid aanvalsplatform, waarbij operationele instructies in een claude.md -bestand werden ingebed dat voor elke interactie aanhoudende context bood.”

De onbekende dreigingsacteur zou AI in een “ongekende graad” hebben gebruikt, met behulp van Claude -code, Anthropic’s agentische coderingstool, om verschillende fasen van de aanvalscyclus te automatiseren, waaronder verkenning, oogst in rekening en netwerkpenetratie.

De verkenningsinspanningen omvatten het scannen van duizenden VPN -eindpunten om gevoelige systemen te markeren, ze te gebruiken om initiële toegang te verkrijgen en de stappen van de opsomming van gebruikers en netwerkontdekking op te volgen om referenties te extraheren en doorzettingsvermogen op de hosts in te stellen.

Bovendien gebruikte de aanvaller Claude -code om op maat gemaakte versies van het beiteltunneling -hulpprogramma te maken om detectie -inspanningen te omzeilen en kwaadaardige uitvoerbare bestanden te verbergen als legitieme Microsoft -tools – een indicatie van hoe AI -tools worden gebruikt om te helpen bij de ontwikkeling van malware -ontwikkeling met defensie -evasion -capaciteiten.

De activiteit, Codenaam GTG-2002, is opmerkelijk voor het gebruik van Claude om op zichzelf “tactische en strategische beslissingen” te nemen en toe te staan om te beslissen welke gegevens moeten worden geëxfiltreerd uit slachtoffernetwerken en gesloten gerichte afpersingsvereisten door de financiële gegevens te analyseren om de financiële gegevens te bepalen om een passend losgeld te bepalen dat varieert van $ 75.000 tot $ 500.000 in Bitcoin.

Claude -code, per antropisch, werd ook gebruikt om gestolen gegevens te organiseren voor inkomsten voor inkomsten, waarbij duizenden individuele records worden uitgetrokken, waaronder persoonlijke identificatiegegevens, adressen, financiële informatie en medische dossiers van meerdere slachtoffers. Vervolgens werd de tool gebruikt om aangepaste losgeldnotities en meerlagige afpersingsstrategieën te maken op basis van geëxfiltreerde gegevensanalyse.

“Agentische AI -tools worden nu gebruikt om zowel technisch advies als actieve operationele ondersteuning te bieden voor aanvallen die anders een team van operators zouden hebben vereist,” zei Anthropic. “Dit maakt verdediging en handhaving steeds moeilijker, omdat deze tools zich kunnen aanpassen aan defensieve maatregelen, zoals malware-detectiesystemen, in realtime.”

Om dergelijke “sfeerhacking” -dreigingen in de toekomst te verminderen, zei het bedrijf dat het een aangepaste classificator ontwikkelde om te screenen op soortgelijk gedrag en gedeelde technische indicatoren met “belangrijke partners”.

Andere gedocumenteerde misbruiken van Claude worden hieronder vermeld –

- Gebruik van Claude door Noord-Koreaanse agenten gerelateerd aan de frauduleuze IT-medewerker van de externe IT-werknemers om uitgebreide fictieve persona’s te creëren met overtuigende professionele achtergronden en projectgeschiedenissen, technische en coderende beoordelingen tijdens het aanvraagproces, en helpen met hun dagelijkse werkzaamheden eenmaal ingehuurd

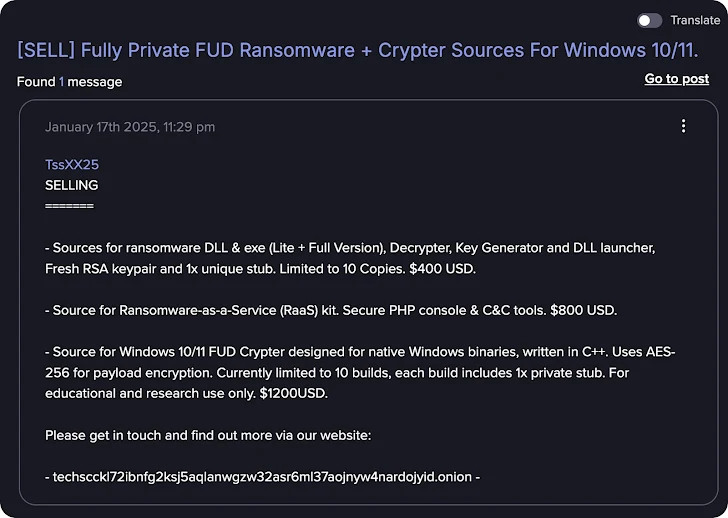

- Gebruik van Claude door een in het Verenigd Koninkrijk gevestigde cybercrimineel, codenaam GTG-5004, om verschillende varianten van ransomware te ontwikkelen, te verkopen en te distribueren met geavanceerde ontwijkingsmogelijkheden, codering en anti-herstelmechanismen, die vervolgens werden verkocht op DarkNet-forums zoals Dread, CryptBB en nul voor andere dreigingsactoren voor $ 400 tot $ 1,200

- Gebruik van Claude door een Chinese dreigingsacteur om cyberactiviteiten te verbeteren die zich richten op de Vietnamese kritieke infrastructuur, waaronder telecommunicatie-aanbieders, overheidsdatabases en agrarische managementsystemen, in de loop van een campagne van 9 maanden

- Gebruik van Claude door een Russisch sprekende ontwikkelaar om malware te maken met geavanceerde ontwijkingsmogelijkheden

- Gebruik van Model Context Protocol (MCP) en Claude door een dreigingsacteur die actief is op het XSS (.) Is Cybercrime Forum met als doel Stealer -logboeken te analyseren en gedetailleerde slachtofferprofielen te bouwen

- Gebruik van Claude-code door een Spaanstalige acteur om een webservice alleen te onderhouden en te verbeteren

- Gebruik van Claude als onderdeel van een Telegram -bot die multimodale AI -tools biedt om romantische zwendelactiviteiten te ondersteunen, reclame voor de chatbot als een “High EQ -model”

- Gebruik van Claude door een onbekende acteur om een operationele synthetische identiteitsservice te starten die roteert tussen drie kaartvalidatieservices, aka “Card Checkers”

Het bedrijf zei ook dat het verijdelde pogingen van Noord -Koreaanse dreigingsactoren die verband hielden met de besmettelijke interviewcampagne om accounts op het platform te maken om hun malware -toolset te verbeteren, phishing -kunstaas te maken en NPM -pakketten te genereren, waardoor ze effectief worden geblokkeerd om eventuele prompts uit te geven.

De casestudy’s dragen bij aan groeiend bewijs dat AI -systemen, ondanks de verschillende bakken erin worden, misbruikt om geavanceerde schema’s op snelheid en op schaal te vergemakkelijken.

“Criminelen met weinig technische vaardigheden gebruiken AI om complexe operaties uit te voeren, zoals het ontwikkelen van ransomware, die eerder jaren van training zouden hebben nodig,” zei Alex Moix van Anthropic, Ken Lebedev en Jacob Klein en riep AI’s vermogen om de barrières tot cybercriminaliteit te verlagen.

“Cybercriminelen en fraudeurs hebben AI in alle fasen van hun activiteiten ingebed. Dit omvat profilering van slachtoffers, het analyseren van gestolen gegevens, het stelen van creditcardinformatie en het creëren van valse identiteiten die fraudebewerkingen kunnen uitbreiden om hun bereik uit te breiden naar meer potentiële doelen.”